Difference between revisions of "Aufgaben:Exercise 1.1: Entropy of the Weather"

| Line 86: | Line 86: | ||

===Musterlösung=== | ===Musterlösung=== | ||

{{ML-Kopf}} | {{ML-Kopf}} | ||

| − | '''(1)''' Bei der Datei „Durchwachsen” sind die beiden Wahrscheinlichkeiten gleich: $p_{\rm B} = p_{\rm G} =0.5$. Damit ergibt sich für die Entropie: | + | '''(1)''' Bei der Datei „Durchwachsen” sind die beiden Wahrscheinlichkeiten gleich: $p_{\rm B} = p_{\rm G} =0.5$. Damit ergibt sich für die Entropie: |

:$$H_{\rm D} = 0.5 \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{0.5} + 0.5 \cdot | :$$H_{\rm D} = 0.5 \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{0.5} + 0.5 \cdot | ||

{\rm log}_2\hspace{0.1cm}\frac{1}{0.5} \hspace{0.15cm}\underline {= 1\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | {\rm log}_2\hspace{0.1cm}\frac{1}{0.5} \hspace{0.15cm}\underline {= 1\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | ||

| − | '''(2)''' Mit $p_{\rm B} = 0.8$ | + | |

| + | '''(2)''' Mit $p_{\rm B} = 0.8$ und $p_{\rm G} =0.2$ erhält man einen kleineren Entropiewert: | ||

:$$H_{\rm R} \hspace{-0.05cm}= \hspace{-0.05cm}0.8 \cdot {\rm log}_2\hspace{0.05cm}\frac{5}{4} \hspace{-0.05cm}+ \hspace{-0.05cm}0.2 \cdot {\rm log}_2\hspace{0.05cm}\frac{5}{1}\hspace{-0.05cm}=\hspace{-0.05cm} | :$$H_{\rm R} \hspace{-0.05cm}= \hspace{-0.05cm}0.8 \cdot {\rm log}_2\hspace{0.05cm}\frac{5}{4} \hspace{-0.05cm}+ \hspace{-0.05cm}0.2 \cdot {\rm log}_2\hspace{0.05cm}\frac{5}{1}\hspace{-0.05cm}=\hspace{-0.05cm} | ||

0.8 \cdot{\rm log}_2\hspace{0.05cm}5\hspace{-0.05cm} - \hspace{-0.05cm}0.8 \cdot {\rm log}_2\hspace{0.05cm}4 \hspace{-0.05cm}+ \hspace{-0.05cm}0.2 \cdot {\rm log}_2 \hspace{0.05cm} 5 \hspace{-0.05cm}=\hspace{-0.05cm} | 0.8 \cdot{\rm log}_2\hspace{0.05cm}5\hspace{-0.05cm} - \hspace{-0.05cm}0.8 \cdot {\rm log}_2\hspace{0.05cm}4 \hspace{-0.05cm}+ \hspace{-0.05cm}0.2 \cdot {\rm log}_2 \hspace{0.05cm} 5 \hspace{-0.05cm}=\hspace{-0.05cm} | ||

| Line 97: | Line 98: | ||

\underline {= 0.722\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | \underline {= 0.722\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | ||

| − | '''(3)''' In der Datei „Angenehm” sind die Wahrscheinlichkeiten gegenüber der Datei „Regenloch” genau vertauscht. Durch diese Vertauschung wird die Entropie jedoch nicht verändert: | + | |

| + | '''(3)''' In der Datei „Angenehm” sind die Wahrscheinlichkeiten gegenüber der Datei „Regenloch” genau vertauscht. Durch diese Vertauschung wird die Entropie jedoch nicht verändert: | ||

:$$H_{\rm A} = H_{\rm R} \hspace{0.15cm} \underline {= 0.722\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | :$$H_{\rm A} = H_{\rm R} \hspace{0.15cm} \underline {= 0.722\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | ||

| − | '''(4)''' Mit $p_{\rm B} = 1/30$ und $p_{\rm G} =29/30$ ergeben sich folgende Informationsgehalte: | + | |

| + | '''(4)''' Mit $p_{\rm B} = 1/30$ und $p_{\rm G} =29/30$ ergeben sich folgende Informationsgehalte: | ||

:$$I_{\rm B} \hspace{0.1cm} = \hspace{0.1cm} {\rm log}_2\hspace{0.1cm}30 = | :$$I_{\rm B} \hspace{0.1cm} = \hspace{0.1cm} {\rm log}_2\hspace{0.1cm}30 = | ||

\frac{{\rm lg}\hspace{0.1cm}30}{{\rm lg}\hspace{0.1cm}2} = \frac{1.477}{0.301} \hspace{0.15cm} | \frac{{\rm lg}\hspace{0.1cm}30}{{\rm lg}\hspace{0.1cm}2} = \frac{1.477}{0.301} \hspace{0.15cm} | ||

| Line 108: | Line 111: | ||

\underline {= 0.049\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | \underline {= 0.049\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | ||

| − | '''(5)''' Die Entropie $H_{\rm P}$ ist der mittlere Informationsgehalt der beiden Ereignisse $\rm B$ und $\rm G$: | + | |

| + | '''(5)''' Die Entropie $H_{\rm P}$ ist der mittlere Informationsgehalt der beiden Ereignisse $\rm B$ und $\rm G$: | ||

:$$H_{\rm P} = \frac{1}{30} \cdot 4.907 + \frac{29}{30} \cdot 0.049 = 0.164 + 0.047 | :$$H_{\rm P} = \frac{1}{30} \cdot 4.907 + \frac{29}{30} \cdot 0.049 = 0.164 + 0.047 | ||

\hspace{0.15cm} | \hspace{0.15cm} | ||

\underline {= 0.211\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | \underline {= 0.211\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$ | ||

| − | Obwohl das Ereignis $\rm B$ seltener auftritt als $\rm G$, ist sein Beitrag zur Entropie größer. | + | *Obwohl (genauer: weil) das Ereignis $\rm B$ seltener auftritt als $\rm G$, ist sein Beitrag zur Entropie größer. |

'''(6)''' Richtig sind die <u>Aussagen 1 und 3</u>: | '''(6)''' Richtig sind die <u>Aussagen 1 und 3</u>: | ||

| − | * | + | *$\rm B$ und $\rm G$ sind bei der Datei „Unbekannt” tatsächlich gleichwahrscheinlich: Die $60$ dargestellten Symbole teilen sich auf in $30$ mal $\rm B$ und $30$ mal $\rm G$. |

| − | *Es bestehen nun aber starke statistische Bindungen innerhalb der zeitlichen Folge. Nach längeren Schönwetterperioden folgen meist viele schlechte Tage am Stück. | + | *Es bestehen nun aber starke statistische Bindungen innerhalb der zeitlichen Folge. Nach längeren Schönwetterperioden folgen meist viele schlechte Tage am Stück. |

| − | *Aufgrund dieser statistischen Abhängigkeit innerhalb der $\rm B/G$–Folge ist $H_\text{U} = 0.722 \; \rm bit/Anfrage$ kleiner als $H_\text{D} = 1 \; \rm bit/Anfrage$. | + | *Aufgrund dieser statistischen Abhängigkeit innerhalb der $\rm B/G$–Folge ist $H_\text{U} = 0.722 \; \rm bit/Anfrage$ kleiner als $H_\text{D} = 1 \; \rm bit/Anfrage$. |

| − | *$H_\text{D}$ ist gleichzeitig das Maximum für $M = 2$ ⇒ die letzte Aussage ist mit Sicherheit falsch. | + | *$H_\text{D}$ ist gleichzeitig das Maximum für $M = 2$ ⇒ die letzte Aussage ist mit Sicherheit falsch. |

{{ML-Fuß}} | {{ML-Fuß}} | ||

Revision as of 15:51, 12 December 2019

Eine Wetterstation fragt täglich verschiedene Regionen ab und bekommt als Antwort jeweils eine Meldung $x$ zurück, nämlich

- $x = \rm B$: Das Wetter ist eher schlecht.

- $x = \rm G$: Das Wetter ist eher gut.

Die Daten wurden über viele Jahre für verschiedene Gebiete in Dateien abgelegt, so dass die Entropien der $\rm B/G$–Folgen ermittelt werden können:

- $$H = p_{\rm B} \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{p_{\rm B}} + p_{\rm G} \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{p_{\rm G}}$$

mit dem Logarithmus dualis

- $${\rm log}_2\hspace{0.1cm}p=\frac{{\rm lg}\hspace{0.1cm}p}{{\rm lg}\hspace{0.1cm}2}\hspace{0.3cm} \left ( = {\rm ld}\hspace{0.1cm}p \right ) \hspace{0.05cm}.$$

„lg” kennzeichnet hierbei den Logarithmus zur Basis $10$. Zu erwähnen ist ferner, dass jeweils noch die Pseudoeinheit $\text{bit/Anfrage}$ anzufügen ist.

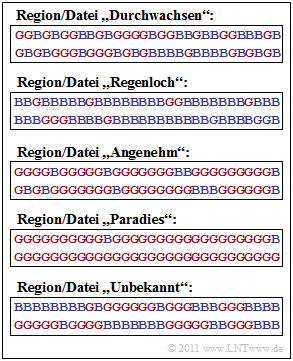

Die Grafik zeigt diese binären Folgen jeweils für $60$ Tage und folgende Regionen:

- Region „Durchwachsen”: $p_{\rm B} = p_{\rm G} =0.5$,

- Region „Regenloch”: $p_{\rm B} = 0.8, \; p_{\rm G} =0.2$,

- Region „Angenehm”: $p_{\rm B} = 0.2, \; p_{\rm G} =0.8$,

- Region „Paradies”: $p_{\rm B} = 1/30, \; p_{\rm G} =29/30$.

Schließlich ist auch noch die Datei „Unbekannt” angegeben, deren statistische Eigenschaften zu schätzen sind.

Hinweise:

- Die Aufgabe gehört zum Kapitel Gedächtnislose Nachrichtenquellen.

- Für die vier ersten Dateien wird vorausgesetzt, dass die Ereignisse $\rm B$ und $\rm G$ statistisch unabhängig seien, eine für die Wetterpraxis eher unrealistische Annahme.

- Die Aufgabe wurde zu einer Zeit konzipiert, als Greta gerade in die Schule kam. Wir überlassen es Ihnen, „Paradies” in „Hölle” umzubenennen.

Fragebogen

Musterlösung

- $$H_{\rm D} = 0.5 \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{0.5} + 0.5 \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{0.5} \hspace{0.15cm}\underline {= 1\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$

(2) Mit $p_{\rm B} = 0.8$ und $p_{\rm G} =0.2$ erhält man einen kleineren Entropiewert:

- $$H_{\rm R} \hspace{-0.05cm}= \hspace{-0.05cm}0.8 \cdot {\rm log}_2\hspace{0.05cm}\frac{5}{4} \hspace{-0.05cm}+ \hspace{-0.05cm}0.2 \cdot {\rm log}_2\hspace{0.05cm}\frac{5}{1}\hspace{-0.05cm}=\hspace{-0.05cm} 0.8 \cdot{\rm log}_2\hspace{0.05cm}5\hspace{-0.05cm} - \hspace{-0.05cm}0.8 \cdot {\rm log}_2\hspace{0.05cm}4 \hspace{-0.05cm}+ \hspace{-0.05cm}0.2 \cdot {\rm log}_2 \hspace{0.05cm} 5 \hspace{-0.05cm}=\hspace{-0.05cm} {\rm log}_2\hspace{0.05cm}5\hspace{-0.05cm} -\hspace{-0.05cm} 0.8 \cdot {\rm log}_2\hspace{0.1cm}4\hspace{-0.05cm} = \hspace{-0.05cm} \frac{{\rm lg} \hspace{0.1cm}5}{{\rm lg}\hspace{0.1cm}2} \hspace{-0.05cm}-\hspace{-0.05cm} 1.6 \hspace{0.15cm} \underline {= 0.722\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$

(3) In der Datei „Angenehm” sind die Wahrscheinlichkeiten gegenüber der Datei „Regenloch” genau vertauscht. Durch diese Vertauschung wird die Entropie jedoch nicht verändert:

- $$H_{\rm A} = H_{\rm R} \hspace{0.15cm} \underline {= 0.722\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$

(4) Mit $p_{\rm B} = 1/30$ und $p_{\rm G} =29/30$ ergeben sich folgende Informationsgehalte:

- $$I_{\rm B} \hspace{0.1cm} = \hspace{0.1cm} {\rm log}_2\hspace{0.1cm}30 = \frac{{\rm lg}\hspace{0.1cm}30}{{\rm lg}\hspace{0.1cm}2} = \frac{1.477}{0.301} \hspace{0.15cm} \underline {= 4.907\,{\rm bit/Anfrage}}\hspace{0.05cm},$$

- $$I_{\rm G} \hspace{0.1cm} = \hspace{0.1cm} {\rm log}_2\hspace{0.1cm}\frac{30}{29} = \frac{{\rm lg}\hspace{0.1cm}1.034}{{\rm lg}\hspace{0.1cm}2} = \frac{1.477}{0.301} \hspace{0.15cm} \underline {= 0.049\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$

(5) Die Entropie $H_{\rm P}$ ist der mittlere Informationsgehalt der beiden Ereignisse $\rm B$ und $\rm G$:

- $$H_{\rm P} = \frac{1}{30} \cdot 4.907 + \frac{29}{30} \cdot 0.049 = 0.164 + 0.047 \hspace{0.15cm} \underline {= 0.211\,{\rm bit/Anfrage}}\hspace{0.05cm}.$$

- Obwohl (genauer: weil) das Ereignis $\rm B$ seltener auftritt als $\rm G$, ist sein Beitrag zur Entropie größer.

(6) Richtig sind die Aussagen 1 und 3:

- $\rm B$ und $\rm G$ sind bei der Datei „Unbekannt” tatsächlich gleichwahrscheinlich: Die $60$ dargestellten Symbole teilen sich auf in $30$ mal $\rm B$ und $30$ mal $\rm G$.

- Es bestehen nun aber starke statistische Bindungen innerhalb der zeitlichen Folge. Nach längeren Schönwetterperioden folgen meist viele schlechte Tage am Stück.

- Aufgrund dieser statistischen Abhängigkeit innerhalb der $\rm B/G$–Folge ist $H_\text{U} = 0.722 \; \rm bit/Anfrage$ kleiner als $H_\text{D} = 1 \; \rm bit/Anfrage$.

- $H_\text{D}$ ist gleichzeitig das Maximum für $M = 2$ ⇒ die letzte Aussage ist mit Sicherheit falsch.