Difference between revisions of "Theory of Stochastic Signals/Linear Combinations of Random Variables"

| Line 6: | Line 6: | ||

}} | }} | ||

==Voraussetzungen und Mittelwerte== | ==Voraussetzungen und Mittelwerte== | ||

| − | In diesem Kapitel | + | In diesem Kapitel „ Linearkombinationen von Zufallsgrößen ” gehen wir von den folgenden Annahmen aus: |

| − | *Die Zufallsgrößen $u$ und $ | + | *Die Zufallsgrößen $u$ und $v$ seien jeweils mittelwertfrei ⇒ $m_u = m_v = 0$ und zudem statistisch unabhängig voneinander ⇒ $ρ_{uv} = 0$. |

| − | *Die beiden Zufallsgrößen $u$ und $ | + | *Die beiden Zufallsgrößen $u$ und $v$ besitzen jeweils gleiche Streuung $σ$. Über die Art der Verteilung wird keine Aussage getroffen. |

| − | *Die beiden Zufallsgrößen $x$ und $y$ seien Linearkombinationen von $u$ und $ | + | *Die beiden Zufallsgrößen $x$ und $y$ seien Linearkombinationen von $u$ und $v$, wobei gilt: |

| − | $$x=A \cdot u + B \cdot v + C,$$ | + | :$$x=A \cdot u + B \cdot v + C,$$ |

| − | $$y=D \cdot u + E \cdot v + F.$$ | + | :$$y=D \cdot u + E \cdot v + F.$$ |

Für die (linearen) Mittelwerte der neuen Zufallsgrößen $x$ und $y$ erhält man nach den allgemeinen Rechenregeln für Erwartungswerte: | Für die (linearen) Mittelwerte der neuen Zufallsgrößen $x$ und $y$ erhält man nach den allgemeinen Rechenregeln für Erwartungswerte: | ||

| − | $$m_x =A \cdot m_u + B \cdot m_v + C =C,$$ | + | :$$m_x =A \cdot m_u + B \cdot m_v + C =C,$$ |

| − | $$m_y =D \cdot m_u + E \cdot m_v + F =F.$$ | + | :$$m_y =D \cdot m_u + E \cdot m_v + F =F.$$ |

| − | Die Koeffizienten $C$ und $F$ geben somit lediglich die Mittelwerte von $x$ und $y$ an. Beide werden auf den folgenden Seiten stets zu 0 gesetzt. | + | Die Koeffizienten $C$ und $F$ geben somit lediglich die Mittelwerte von $x$ und $y$ an. Beide werden auf den folgenden Seiten stets zu $0$ gesetzt. |

==Resultierender Korrelationskoeffizient== | ==Resultierender Korrelationskoeffizient== | ||

| − | Betrachten wir nun die Varianzen nach den Linearkombinationen. Für die Zufallsgröße $x$ gilt unabhängig vom Parameter $C$: | + | Betrachten wir nun die '''Varianzen''' nach den Linearkombinationen. Für die Zufallsgröße $x$ gilt unabhängig vom Parameter $C$: |

| − | $$\sigma _x ^2 = {\rm E}[x ^{\rm 2}] = A^{\rm 2} \cdot {\rm E}[u^{\rm 2}] + B^{\rm 2} \cdot {\rm E}[v^{\rm 2}] + {\rm 2} \cdot A \cdot B \cdot {\rm E}[u \cdot v].$$ | + | :$$\sigma _x ^2 = {\rm E}[x ^{\rm 2}] = A^{\rm 2} \cdot {\rm E}[u^{\rm 2}] + B^{\rm 2} \cdot {\rm E}[v^{\rm 2}] + {\rm 2} \cdot A \cdot B \cdot {\rm E}[u \cdot v].$$ |

| − | Die Erwartungswerte von $u^2$ und $ | + | Die Erwartungswerte von $u^2$ und $v^2$ sind definitionsgemäß jeweils gleich $σ^2$, weil $u$ und $v$ mittelwertfrei sind. Da $u$ und $v$ zudem als statistisch unabhängig vorausgesetzt werden, kann man für den Erwartungswert des Produktes auch schreiben: |

| − | $${\rm E}[u \cdot v] = {\rm E}[u] \cdot {\rm E}[v] = m_u \cdot m_v = \rm 0.$$ | + | :$${\rm E}[u \cdot v] = {\rm E}[u] \cdot {\rm E}[v] = m_u \cdot m_v = \rm 0.$$ |

Damit erhält man für die Varianzen der durch Linearkombinationen gebildeten Zufallsgrößen: | Damit erhält man für die Varianzen der durch Linearkombinationen gebildeten Zufallsgrößen: | ||

| − | $$\sigma _x ^2 =(A^2 + B^2) \cdot \sigma ^2,$$ | + | :$$\sigma _x ^2 =(A^2 + B^2) \cdot \sigma ^2,$$ |

| − | $$\sigma _y ^2 =(D^2 + E^2) \cdot \sigma ^2.$$ | + | :$$\sigma _y ^2 =(D^2 + E^2) \cdot \sigma ^2.$$ |

| − | Die Kovarianz $μ_{xy}$ ist bei mittelwertfreien Zufallsgrößen $x$ und $y$ | + | |

| − | $$\mu_{xy } = m_{xy } = {\rm E}[x \cdot y] = {\rm E}[(A \cdot u + B \cdot v)(D \cdot u + E \cdot v)].$$ | + | Die '''Kovarianz''' $μ_{xy}$ ist bei mittelwertfreien Zufallsgrößen $x$ und $y$ ⇒ $C = F = 0$ identisch mit dem gemeinsamen Moment $m_{xy}$: |

| + | :$$\mu_{xy } = m_{xy } = {\rm E}[x \cdot y] = {\rm E}[(A \cdot u + B \cdot v)(D \cdot u + E \cdot v)].$$ | ||

Beachten Sie hierbei, dass E[ $\,$ ] einen Erwartungswert bezeichnet, während $E$ eine Variable beschreibt. Nach Auswertung dieser Gleichung in analoger Weise zu oben folgt daraus: | Beachten Sie hierbei, dass E[ $\,$ ] einen Erwartungswert bezeichnet, während $E$ eine Variable beschreibt. Nach Auswertung dieser Gleichung in analoger Weise zu oben folgt daraus: | ||

| − | $$\mu_{xy } = (A \cdot D + B \cdot E) \cdot \sigma^{\rm 2 } | + | :$$\mu_{xy } = (A \cdot D + B \cdot E) \cdot \sigma^{\rm 2 } |

| − | + | \hspace{0.3cm}\Rightarrow\hspace{0.3cm} | |

\rho_{xy } = \frac{\rho_{xy }}{\sigma_x \cdot \sigma_y} = \frac {A \cdot D + B \cdot E}{\sqrt{(A^{\rm 2}+B^{\rm 2})(D^{\rm 2}+E^{\rm 2})}}. $$ | \rho_{xy } = \frac{\rho_{xy }}{\sigma_x \cdot \sigma_y} = \frac {A \cdot D + B \cdot E}{\sqrt{(A^{\rm 2}+B^{\rm 2})(D^{\rm 2}+E^{\rm 2})}}. $$ | ||

| − | Schließen wir die Sonderfälle $A = B =$ | + | Schließen wir die Sonderfälle $A = B = 0$ (d. h. $x ≡ 0$ ) sowie $D = E = 0$ (d. h. $y ≡ 0$ ) aus, so liefert die Gleichung stets eindeutige Werte für den Korrelationskoeffizienten im Bereich $–1 ≤ ρ_{xy} ≤ +1$. |

| − | {{ | + | {{Box}} |

| − | Setzen wir zum Beispiel $A = E =$ | + | '''Beispiele:''' |

| + | |||

| + | '''(1)''' Setzen wir zum Beispiel $A = E = 0$, so ergibt sich der Korrelationskoeffizient $ρ_{xy} = 0$. Dieses Ergebnis ist einsichtig: Nun hängt $x$ nur noch von $v$ und $y$ ausschließlich von $u$ ab. Da aber $u$ und $v$ als statistisch unabhängig angenommen wurden, bestehen keine Beziehungen zwischen $x$ und $y$. – Ebenso ergibt sich $ρ_{xy} = 0$ für $B = D = 0$. | ||

| − | Die Konstellation $B = E =$ 0 führt dazu, dass sowohl $x$ als auch $y$ nur noch von $u$ abhängen. In diesem Fall ergibt sich für den Korrelationskoeffizienten $ρ_{xy} =$ | + | '''(2)''' Die Konstellation $B = E = 0$ 0 führt dazu, dass sowohl $x$ als auch $y$ nur noch von $u$ abhängen. In diesem Fall ergibt sich für den Korrelationskoeffizienten $ρ_{xy} = ±1$: |

$$\rho_{xy } = \frac {A \cdot D }{\sqrt{A^{\rm 2}\cdot D^{\rm 2}}} = \frac {A \cdot D }{|A| \cdot |D| } =\pm 1. $$ | $$\rho_{xy } = \frac {A \cdot D }{\sqrt{A^{\rm 2}\cdot D^{\rm 2}}} = \frac {A \cdot D }{|A| \cdot |D| } =\pm 1. $$ | ||

| − | Besitzen $A$ und $D$ gleiches Vorzeichen, so ist $ρ_{xy} = | + | |

| + | *Besitzen $A$ und $D$ gleiches Vorzeichen, so ist $ρ_{xy} = +1$. | ||

| + | *Bei unterschiedlichen Vorzeichen ergibt sich der Korrelationskoeffizient $–1$. | ||

| + | *Auch für $A = D = 0$ ergibt sich der Koeffizient $ρ_{xy} = ±1$. | ||

{{end}} | {{end}} | ||

| Line 64: | Line 70: | ||

Mit den Parameterwerten $A =$ –0.625, $B =$ 0.781, $D =$ 1.501 und $E =$ –0.390 entsprechend der rechten Grafik erhält man – im statistischen Sinne – das gleiche Resultat, auch wenn sich die beiden Punktwolken im Detail unterscheiden. | Mit den Parameterwerten $A =$ –0.625, $B =$ 0.781, $D =$ 1.501 und $E =$ –0.390 entsprechend der rechten Grafik erhält man – im statistischen Sinne – das gleiche Resultat, auch wenn sich die beiden Punktwolken im Detail unterscheiden. | ||

{{end}} | {{end}} | ||

| + | |||

| + | ==Aufgaben zum Kapitel== | ||

| + | |||

| + | [[Aufgaben:4.4 Gaußsche 2D-WDF|Aufgabe 4.4: Gaußsche 2D-WDF]] | ||

| + | |||

| + | [[Aufgaben:4.4Z Höhenlinien der 2D-WDF|Zusatzaufgabe 4.4Z: Höhenlinien der 2D-WDF]] | ||

| + | |||

| + | [[Aufgaben:4.5 2D-Prüfungsauswertung|Aufgabe 4.5: 2D-Prüfungsauswertung]] | ||

| + | |||

| + | [[Aufgaben:4.6 Koordinatendrehung|Aufgabe 4.6: Koordinatendrehung]] | ||

{{Display}} | {{Display}} | ||

Revision as of 16:54, 20 March 2017

Contents

Voraussetzungen und Mittelwerte

In diesem Kapitel „ Linearkombinationen von Zufallsgrößen ” gehen wir von den folgenden Annahmen aus:

- Die Zufallsgrößen $u$ und $v$ seien jeweils mittelwertfrei ⇒ $m_u = m_v = 0$ und zudem statistisch unabhängig voneinander ⇒ $ρ_{uv} = 0$.

- Die beiden Zufallsgrößen $u$ und $v$ besitzen jeweils gleiche Streuung $σ$. Über die Art der Verteilung wird keine Aussage getroffen.

- Die beiden Zufallsgrößen $x$ und $y$ seien Linearkombinationen von $u$ und $v$, wobei gilt:

- $$x=A \cdot u + B \cdot v + C,$$

- $$y=D \cdot u + E \cdot v + F.$$

Für die (linearen) Mittelwerte der neuen Zufallsgrößen $x$ und $y$ erhält man nach den allgemeinen Rechenregeln für Erwartungswerte:

- $$m_x =A \cdot m_u + B \cdot m_v + C =C,$$

- $$m_y =D \cdot m_u + E \cdot m_v + F =F.$$

Die Koeffizienten $C$ und $F$ geben somit lediglich die Mittelwerte von $x$ und $y$ an. Beide werden auf den folgenden Seiten stets zu $0$ gesetzt.

Resultierender Korrelationskoeffizient

Betrachten wir nun die Varianzen nach den Linearkombinationen. Für die Zufallsgröße $x$ gilt unabhängig vom Parameter $C$:

- $$\sigma _x ^2 = {\rm E}[x ^{\rm 2}] = A^{\rm 2} \cdot {\rm E}[u^{\rm 2}] + B^{\rm 2} \cdot {\rm E}[v^{\rm 2}] + {\rm 2} \cdot A \cdot B \cdot {\rm E}[u \cdot v].$$

Die Erwartungswerte von $u^2$ und $v^2$ sind definitionsgemäß jeweils gleich $σ^2$, weil $u$ und $v$ mittelwertfrei sind. Da $u$ und $v$ zudem als statistisch unabhängig vorausgesetzt werden, kann man für den Erwartungswert des Produktes auch schreiben:

- $${\rm E}[u \cdot v] = {\rm E}[u] \cdot {\rm E}[v] = m_u \cdot m_v = \rm 0.$$

Damit erhält man für die Varianzen der durch Linearkombinationen gebildeten Zufallsgrößen:

- $$\sigma _x ^2 =(A^2 + B^2) \cdot \sigma ^2,$$

- $$\sigma _y ^2 =(D^2 + E^2) \cdot \sigma ^2.$$

Die Kovarianz $μ_{xy}$ ist bei mittelwertfreien Zufallsgrößen $x$ und $y$ ⇒ $C = F = 0$ identisch mit dem gemeinsamen Moment $m_{xy}$:

- $$\mu_{xy } = m_{xy } = {\rm E}[x \cdot y] = {\rm E}[(A \cdot u + B \cdot v)(D \cdot u + E \cdot v)].$$

Beachten Sie hierbei, dass E[ $\,$ ] einen Erwartungswert bezeichnet, während $E$ eine Variable beschreibt. Nach Auswertung dieser Gleichung in analoger Weise zu oben folgt daraus:

- $$\mu_{xy } = (A \cdot D + B \cdot E) \cdot \sigma^{\rm 2 } \hspace{0.3cm}\Rightarrow\hspace{0.3cm} \rho_{xy } = \frac{\rho_{xy }}{\sigma_x \cdot \sigma_y} = \frac {A \cdot D + B \cdot E}{\sqrt{(A^{\rm 2}+B^{\rm 2})(D^{\rm 2}+E^{\rm 2})}}. $$

Schließen wir die Sonderfälle $A = B = 0$ (d. h. $x ≡ 0$ ) sowie $D = E = 0$ (d. h. $y ≡ 0$ ) aus, so liefert die Gleichung stets eindeutige Werte für den Korrelationskoeffizienten im Bereich $–1 ≤ ρ_{xy} ≤ +1$.

Beispiele:

(1) Setzen wir zum Beispiel $A = E = 0$, so ergibt sich der Korrelationskoeffizient $ρ_{xy} = 0$. Dieses Ergebnis ist einsichtig: Nun hängt $x$ nur noch von $v$ und $y$ ausschließlich von $u$ ab. Da aber $u$ und $v$ als statistisch unabhängig angenommen wurden, bestehen keine Beziehungen zwischen $x$ und $y$. – Ebenso ergibt sich $ρ_{xy} = 0$ für $B = D = 0$.

(2) Die Konstellation $B = E = 0$ 0 führt dazu, dass sowohl $x$ als auch $y$ nur noch von $u$ abhängen. In diesem Fall ergibt sich für den Korrelationskoeffizienten $ρ_{xy} = ±1$: $$\rho_{xy } = \frac {A \cdot D }{\sqrt{A^{\rm 2}\cdot D^{\rm 2}}} = \frac {A \cdot D }{|A| \cdot |D| } =\pm 1. $$

- Besitzen $A$ und $D$ gleiches Vorzeichen, so ist $ρ_{xy} = +1$.

- Bei unterschiedlichen Vorzeichen ergibt sich der Korrelationskoeffizient $–1$.

- Auch für $A = D = 0$ ergibt sich der Koeffizient $ρ_{xy} = ±1$.

Erzeugung korrelierter Zufallsgrößen

Die Gleichungen der letzten Seite können zur Erzeugung einer zweidimensionalen Zufallsgröße $(x, y)$ mit vorgegebenen Kenngrößen $σ_x, σ_y$ und $ρ_{xy}$ genutzt werden. Wenn außer diesen drei Sollwerten keine weiteren Voraussetzungen getroffen werden, ist einer der vier Koeffizienten $A, B, D$ und $E$ frei wählbar. Im Folgenden wird stets willkürlich $E =$ 0 gesetzt.

Mit der weiteren Festlegung, dass die statistisch voneinander unabhängigen Zufallsgrößen $u$ und $υ$ jeweils die gleiche Streuung $σ =$ 1 aufweisen, erhält man: $$D = \sigma_y, \hspace{2cm} A = \sigma_x \cdot \rho_{xy}, \hspace{2cm} B = \sigma_x \cdot \sqrt {1-\rho_{xy}^2}.$$ Bei $σ ≠$ 1 sind diese Werte jeweils noch durch $σ$ zu dividieren.

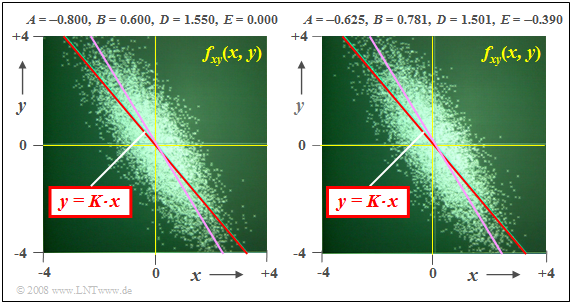

Zur Erzeugung einer 2D–Zufallsgröße mit den gewünschten Kennwerten $σ_x =$ 1, $σ_y =$ 1.55 und $ρ_{xy} =$ –0.8 eignet sich z. B. der Parametersatz $A =$ –0.8, $B =$ 0.6, $D =$ 1.55, $E =$ 0, der dem linken Bild zugrundeliegt.

- Die Zufallsgrößen $u$ und $υ$ sind dabei gaußförmig und besitzen jeweils die Streuung $σ =$ 1.

- Die Korrelationsgerade $y = K · x$ (rot dargestellt) verläuft unter einem Winkel von etwa –50 Grad. Violett eingezeichnet ist die Ellipsenhauptachse.

Mit den Parameterwerten $A =$ –0.625, $B =$ 0.781, $D =$ 1.501 und $E =$ –0.390 entsprechend der rechten Grafik erhält man – im statistischen Sinne – das gleiche Resultat, auch wenn sich die beiden Punktwolken im Detail unterscheiden.

Aufgaben zum Kapitel

Zusatzaufgabe 4.4Z: Höhenlinien der 2D-WDF

Aufgabe 4.5: 2D-Prüfungsauswertung

Aufgabe 4.6: Koordinatendrehung