Difference between revisions of "Aufgaben:Exercise 3.11: Erasure Channel"

m (Guenter verschob die Seite 3.10 Auslöschungskanal nach 3.11 Auslöschungskanal) |

|||

| Line 3: | Line 3: | ||

}} | }} | ||

| − | [[File:P_ID2791__Inf_A_3_10.png|right|]] | + | [[File:P_ID2791__Inf_A_3_10.png|right|Auslöschungskanal mit vier Eingängen und fünf Ausgängen]] |

Betrachtet wird ein Auslöschungskanal mit | Betrachtet wird ein Auslöschungskanal mit | ||

| − | + | * den M Eingängen $x ∈ X = \{1, 2, ... , M\}$, und | |

| − | + | * den $M + 1$ Ausgängen $y ∈ Y = \{1, 2, ... , M, \text{E}\}.$ | |

| − | Die Grafik zeigt das Modell für den Sonderfall $M = 4$. Das Sinkensymbol $y = E$ berücksichtigt eine Auslöschung (englisch: Erasure) für den Fall, dass der Empfänger keine hinreichend gesicherte Entscheidung treffen kann | + | |

| + | Die Grafik zeigt das Modell für den Sonderfall $M = 4$. Das Sinkensymbol $y = \text{E}$ berücksichtigt eine ''Auslöschung'' (englisch: ''Erasure'') für den Fall, dass der Empfänger keine hinreichend gesicherte Entscheidung treffen kann. | ||

Die Übergangswahrscheinlichkeiten sind für $1 ≤ μ ≤ M$ wie folgt gegeben: | Die Übergangswahrscheinlichkeiten sind für $1 ≤ μ ≤ M$ wie folgt gegeben: | ||

| − | $${\rm Pr}(Y \hspace{-0.05cm} = \mu\hspace{-0.05cm}\mid \hspace{-0.05cm} X \hspace{-0.05cm}= \mu) | + | :$${\rm Pr}(Y \hspace{-0.05cm} = \mu\hspace{-0.05cm}\mid \hspace{-0.05cm} X \hspace{-0.05cm}= \mu) = 1-\lambda \hspace{0.05cm},$$ |

| − | $${\rm Pr}(Y \hspace{-0.05cm} = {\rm E}\hspace{-0.05cm}\mid \hspace{-0.05cm} X \hspace{-0.05cm}= \mu) | + | :$${\rm Pr}(Y \hspace{-0.05cm} = {\rm E}\hspace{-0.05cm}\mid \hspace{-0.05cm} X \hspace{-0.05cm}= \mu) = \lambda \hspace{0.05cm}.$$ |

| − | Gesucht | + | Gesucht werden: |

| − | + | * die Kapazität $C_{M\rm –EC}$ dieses ''M–ary Erasure Channels'', | |

| − | + | * die Kapazität $C_{\rm BEC}$ des [[Kanalcodierung/Kanalmodelle_und_Entscheiderstrukturen#Binary_Erasure_Channel_.E2.80.93_BEC|Binary Erasure Channels]] als Sonderfall des obigen Modells, | |

| − | '' | + | |

| + | |||

| + | ''Hinweise:'' | ||

| + | *Die Aufgabe gehört zum Kapitel [[Informationstheorie/Anwendung_auf_die_Digitalsignalübertragung|Anwendung auf die Digitalsignalübertragung]]. | ||

| + | *Bezug genommen wird insbesondere auf die Seite [[Informationstheorie/Anwendung_auf_die_Digitalsignalübertragung#Informationstheoretisches_Modell_der_Digitalsignal.C3.BCbertragung|Informationstheoretisches Modell der Digitalsignalübertragung]]. | ||

| + | *Im obigen Schaubild sind Auslöschungen (Wahrscheinlichkeit $λ$) blau gezeichnet und „richtige Übertragungswege” (also von $X = μ$ nach $Y = μ$) blau ($1 ≤ μ ≤ M$). | ||

| + | *Sollte die Eingabe des Zahlenwertes „0” erforderlich sein, so geben Sie bitte „0.” ein. | ||

| + | |||

| Line 24: | Line 32: | ||

{ Welches $P_X(X)$ ist zur Kanalkapazitätsberechnung allgemein anzusetzen? | { Welches $P_X(X)$ ist zur Kanalkapazitätsberechnung allgemein anzusetzen? | ||

|type="[]"} | |type="[]"} | ||

| − | - $P_X(X) = (0.5, 0.5)$ | + | - $P_X(X) = (0.5, 0.5),$ |

| − | + $P_X(X) = (1/M, 1/M, ... , 1/M)$ | + | + $P_X(X) = (1/M, 1/M, \text{...} , 1/M),$ |

| − | - $P_X(X) = (0.1, 0.2, 0.3, 0.4)$ | + | - $P_X(X) = (0.1, 0.2, 0.3, 0.4).$ |

| − | {Wie viele Wahrscheinlichkeiten $p_{μκ} = Pr[(X = μ) ∩ (Y = κ)]$ sind | + | {Wie viele Wahrscheinlichkeiten $p_{μκ} = {\rm Pr}[(X = μ) ∩ (Y = κ)]$ sind ungleich Null? |

|type="[]"} | |type="[]"} | ||

| − | - Genau $M · (M + 1)$ | + | - Genau $M · (M + 1)$, |

| − | - Genau $M$ | + | - Genau $M$, |

| − | + Genau $2 · M$ | + | + Genau $2 · M$. |

{Wie groß ist die Sinkenentropie allgemein und für $M = 4$ und $λ = 0.2$? | {Wie groß ist die Sinkenentropie allgemein und für $M = 4$ und $λ = 0.2$? | ||

|type="{}"} | |type="{}"} | ||

| − | $ | + | $H(Y) \ = \ $ { 2.322 3% } $\ \rm bit$ |

| − | {Berechnen Sie die Irrelevanz. Welcher Wert ergibt sich für $M = 4 | + | {Berechnen Sie die Irrelevanz. Welcher Wert ergibt sich für $M = 4$ und $λ = 0.2$? |

|type="{}"} | |type="{}"} | ||

| − | $ | + | $H(Y|X) \ = \ $ { 0.722 3% } $\ \rm bit$ |

| − | {Wie groß ist die Kanalkapazität in Abhängigkeit von $M$? | + | {Wie groß ist die Kanalkapazität $C$ in Abhängigkeit von $M$? |

|type="{}"} | |type="{}"} | ||

| − | $M = 4: C$ | + | $M = 4\text{:} \ \ C\ = \ $ { 1.6 3 % } $\ \rm bit$ |

| − | $M = 2: C$ | + | $M = 2\text{:} \ \ C\ = \ $ { 0.8 3% } $\ \rm bit$ |

{Wie lautet die Kanalkapazität des BEC–Kanals in kompakter Form? | {Wie lautet die Kanalkapazität des BEC–Kanals in kompakter Form? | ||

|type="[]"} | |type="[]"} | ||

| − | + $C_{BEC} = 1 – λ$ | + | + $C_{\rm BEC} = 1 – λ,$ |

| − | - $C_{BEC} = 1 – | + | - $C_{\rm BEC} = 1 – H_{\rm bin}(λ).$ |

Revision as of 12:21, 7 June 2017

Betrachtet wird ein Auslöschungskanal mit

- den M Eingängen $x ∈ X = \{1, 2, ... , M\}$, und

- den $M + 1$ Ausgängen $y ∈ Y = \{1, 2, ... , M, \text{E}\}.$

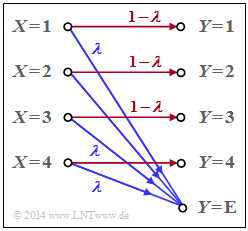

Die Grafik zeigt das Modell für den Sonderfall $M = 4$. Das Sinkensymbol $y = \text{E}$ berücksichtigt eine Auslöschung (englisch: Erasure) für den Fall, dass der Empfänger keine hinreichend gesicherte Entscheidung treffen kann.

Die Übergangswahrscheinlichkeiten sind für $1 ≤ μ ≤ M$ wie folgt gegeben:

- $${\rm Pr}(Y \hspace{-0.05cm} = \mu\hspace{-0.05cm}\mid \hspace{-0.05cm} X \hspace{-0.05cm}= \mu) = 1-\lambda \hspace{0.05cm},$$

- $${\rm Pr}(Y \hspace{-0.05cm} = {\rm E}\hspace{-0.05cm}\mid \hspace{-0.05cm} X \hspace{-0.05cm}= \mu) = \lambda \hspace{0.05cm}.$$

Gesucht werden:

- die Kapazität $C_{M\rm –EC}$ dieses M–ary Erasure Channels,

- die Kapazität $C_{\rm BEC}$ des Binary Erasure Channels als Sonderfall des obigen Modells,

Hinweise:

- Die Aufgabe gehört zum Kapitel Anwendung auf die Digitalsignalübertragung.

- Bezug genommen wird insbesondere auf die Seite Informationstheoretisches Modell der Digitalsignalübertragung.

- Im obigen Schaubild sind Auslöschungen (Wahrscheinlichkeit $λ$) blau gezeichnet und „richtige Übertragungswege” (also von $X = μ$ nach $Y = μ$) blau ($1 ≤ μ ≤ M$).

- Sollte die Eingabe des Zahlenwertes „0” erforderlich sein, so geben Sie bitte „0.” ein.

Fragebogen

Musterlösung

2.Von jedem Quellensymbol $X = μ$ kommt man sowohl zum Sinkensymbol $Y = μ$ als auch zum Erasure $Y = E ⇒$ Zutreffend ist dementsprechend der Lösungsvorschlag 3 $⇒$ Genau $2M$ Verbindungen.

3. Alle Wahrscheinlichkeiten $Pr(Y = 1), ... , Pr(Y = M)$ sind gleich groß. Man erhält für $μ = 1, ... , M$: $${\rm Pr}(Y \hspace{-0.05cm} = \mu) = \frac{ 1-\lambda }{M} \hspace{0.05cm}$$ Außerdem kommt man von jedem Quellensymbol $X = 1, ... , X = M$ auch zum Erasure$ Y = E$: $${\rm Pr}(Y \hspace{-0.05cm} = {\rm E}) = \lambda \hspace{0.05cm}$$ Die Kontrolle ergibt, dass die Summe aller $M + 1$ Sinkensymbolwahrscheinlichkeiten tatsächlich 1 ergibt. Daraus folgt für die Sinkenentropie $$H(Y) = M \cdot \frac{ 1-\lambda }{M} \cdot {\rm log}_2 \hspace{0.1cm} \frac{M}{1 - \lambda} \hspace{0.15cm}+\hspace{0.15cm} \lambda \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{\lambda} \hspace{0.05cm}$$ Zusammengefasst ergibt dies mit der binären Entropiefunktion: $$H(Y) = (1-\lambda) \cdot {\rm log}_2 \hspace{0.1cm} M \hspace{0.15cm}+\hspace{0.15cm} H_{\rm bin} (\lambda ) \hspace{0.05cm}$$ und mit $M = 4$ sowie$ λ = 0.2$: $$H(Y) = 1.6 \,{\rm bit} + H_{\rm bin} (0.2 ) \hspace{0.15cm} \underline {=2.322\,{\rm bit}} \hspace{0.05cm}$$

4. Für die $2M$ Verbundwahrscheinlichkeiten $⇒ pμκ = Pr [(X = μ) ∩ (Y = κ)] ≠ 0$ und die zugehörigen bedingten Wahrscheinlichkeiten $⇒ pκ|μ = Pr(Y = κ|X = μ)$ gilt:

- Die Kombination $p_{μκ} = (1 – λ)/M$ und $p_{κ|μ} = 1 – λ$ kommt $M$ mal vor.

- Die Kombination $p_{μκ} = λ/M$ und $p_{κ|μ} = λ$ kommt ebenfalls $M$ mal vor.

$$ H(Y \hspace{-0.1cm}\mid \hspace{-0.1cm} X) \hspace{-0.15cm} =\hspace{-0.15cm} M \cdot \frac{ 1-\lambda }{M} \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{1 - \lambda} \hspace{0.15cm}+\hspace{0.15cm}M \cdot \frac{ \lambda }{M} \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{ \lambda} =$$ $$=\hspace{-0.15cm} ( 1-\lambda) \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{1 - \lambda} \hspace{0.15cm}+\hspace{0.15cm} \lambda \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{ \lambda} = H_{\rm bin} (\lambda)\hspace{0.05cm}$$ Das Ergebnis ist unabhängig von $M$. Mit $λ = 0.2$ erhält man: $$H(Y \hspace{-0.1cm}\mid \hspace{-0.1cm} X) = H_{\rm bin} (0.2 ) \hspace{0.15cm} \underline {=0.722\,{\rm bit}} \hspace{0.05cm}$$

5. Die Kanalkapazität $C$ ist gleich der maximalen Transinformation $I(X; Y)$, wobei die Maximierung hinsichtlich $P_X(X)$ bereits durch den symmetrischen Ansatz berücksichtigt wurde: $$ C \hspace{-0.15cm} = \hspace{-0.15cm} \max_{P_X(X)} \hspace{0.15cm} I(X;Y) = H(Y) - H(Y \hspace{-0.1cm}\mid \hspace{-0.1cm} X) =$$ $$= \hspace{-0.15cm} ( 1-\lambda) \cdot {\rm log}_2 \hspace{0.1cm} M + H_{\rm bin} (\lambda) - H_{\rm bin} (\lambda) = ( 1-\lambda) \cdot {\rm log}_2 \hspace{0.1cm} M \hspace{0.05cm}$$ $$\Rightarrow \hspace{0.3cm} M \hspace{-0.15cm} = \hspace{-0.15cm} 4: \hspace{0.5cm} \underline {C=1.6\,\,{\rm bit}} \hspace{0.05cm}$$ $$M \hspace{-0.15cm} =\hspace{-0.15cm} 2: \hspace{0.5cm} \underline {C=0.8\,\,{\rm bit}} \hspace{0.05cm}$$

6. Der BEC–Kanal ist ein Sonderfall des hier betrachteten allgemeinen Modells mit $M = 2$: $$C_{\rm BEC} = 1-\lambda \hspace{0.05cm}$$ Richtig ist somit der Lösungsvorschlag 1. Der zweite Lösungsvorschlag gilt dagegen für den Binary Symmetric Channel (BSC) mit der Verfälschungswahrscheinlichkeit $λ$.