Difference between revisions of "Applets:Korrelation und Regressionsgerade"

m (Text replacement - "„" to """) |

|||

| (15 intermediate revisions by 3 users not shown) | |||

| Line 1: | Line 1: | ||

| − | {{LntAppletLink| | + | {{LntAppletLink|correlation}} |

==Programmbeschreibung== | ==Programmbeschreibung== | ||

<br> | <br> | ||

| − | + | Als einfaches Beispiel einer 2D-Zufallsgröße $(X, Y)$ betrachten wir den Fall, dass diese nur vier Werte annehmen kann: | |

| − | + | *Punkt $1$ bei $(x_1, \ y_1)$ mit Wahrscheinlichkeit $p_1$: Die Parameter $x_1, \ y_1, \ p_1$ sind im Applet per Slider einstellbar. | |

| − | + | *Punkt $2$ bei $(x_2, \ y_2)$ mit Wahrscheinlichkeit $p_2$: Die Parameter liegen durch den Punkt $1$ fest: $x_2=-x_1, \ y_2=-y_1, \ p_2=p_1$. | |

| − | + | *Punkt $3$ bei $(+1, +1)$ mit Wahrscheinlichkeit $p_3 = 0.5-p_1$: Die Lage dieses Punktes ist im Applet fest vorgegeben. | |

| − | + | *Punkt $4$ bei $(-1, -1)$ mit Wahrscheinlichkeit $p_4 = p_3$: Dieser Punkt liegt ebenso wie der Punkt $3$ auf der Winkelhalbierenden. | |

| − | |||

| − | |||

| − | |||

| − | + | Für diese Konstellation werden im Applet folgende Gerade durch den Nullpunkt dargestellt: | |

| − | + | * Die Regressionsgerade $R_{X \to Y}$ unter dem Winkel $\theta_{X \to Y}$ ⇒ blaue Kurve, | |

| − | + | * die Regressionsgerade $R_{Y \to X}$ unter dem Winkel $\theta_{Y \to X}$ ⇒ rote Kurve, | |

| − | + | * eine Hilfsgerade "$\rm (HG)$" unter dem Winkel $\theta_{\rm HG}$ ⇒ grüne Kurve, optional. | |

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | \ | ||

| − | |||

| − | |||

| − | |||

| − | |||

| − | + | Als Zahlenwerte werden die zur Berechnung von $\theta_{X \to Y}$ und $\theta_{Y \to X}$ benötigten statistischen Kenngrößen ausgegeben: | |

| − | \ | + | * die Streuungen (Standardabweichungen) $\sigma_X$ und $\sigma_Y$ der Komponenten $X$ bzw. $Y$, |

| − | + | *die Kovarianz $\mu_{XY}$ ⇒ Zentralmoment erster Ordnung der 2D-Zufallsgröße $(X, Y)$, | |

| − | \ | + | *der Korrelationskoeffizient $\rho_{XY}$ zwischen den 2D-Zufallsgröße $X$ und $Y$. |

| − | ( | ||

| − | + | ||

| + | Mit Hilfe der (optionalen) Hilfsgeraden sowie der gestrichelt eingezeichneten Abstände der Punkte in $x$– und $y$–Richtung zu dieser lässt sich nachvollziehen, dass | ||

| − | + | * die rote Regressionsgerade $R_{X \to Y}$ die Eigenschaft hat, dass der mittlere quadrische Abstand aller Punkte in $y$–Richtung ⇒ ${\rm MQA}_Y$ von dieser minimal ist, | |

| − | \ | + | * während für die blaue Regressionsgerade $R_{Y \to X}$ der mittlere quadrische Abstand aller Punkte in $x$–Richtung ⇒ ${\rm MQA}_X$ zum Minimum führt. |

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | + | ||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

==Theoretischer Hintergrund== | ==Theoretischer Hintergrund== | ||

| Line 88: | Line 49: | ||

:$$\mu_{XY}= {\rm E}\big [ X \cdot Y \big ] = \int_{-\infty}^{+\infty}\hspace{0.2cm}\int_{-\infty}^{+\infty} x\ \cdot y \cdot f_{XY}(x,y) \, {\rm d}x\, {\rm d}y\hspace{0.05cm}.$$ | :$$\mu_{XY}= {\rm E}\big [ X \cdot Y \big ] = \int_{-\infty}^{+\infty}\hspace{0.2cm}\int_{-\infty}^{+\infty} x\ \cdot y \cdot f_{XY}(x,y) \, {\rm d}x\, {\rm d}y\hspace{0.05cm}.$$ | ||

| − | Bei | + | Bei statistischer Unabhängigkeit der beiden Komponenten $X$ und $Y$ ist die Kovarianz $\mu_{XY} \equiv 0$. |

*Das Ergebnis $\mu_{XY} = 0$ ist auch bei statistisch abhängigen Komponenten $X$ und $Y$ möglich, nämlich dann, wenn diese unkorreliert, also ''linear unabhängig'' sind. | *Das Ergebnis $\mu_{XY} = 0$ ist auch bei statistisch abhängigen Komponenten $X$ und $Y$ möglich, nämlich dann, wenn diese unkorreliert, also ''linear unabhängig'' sind. | ||

| Line 135: | Line 96: | ||

<br clear=all> | <br clear=all> | ||

| − | === | + | ===Eigenschaften der Regressionsgeraden=== |

[[File:Korrelation_5_neu.png|frame|Gaußsche 2D-WDF mit Korrelationsgerade $K$]] | [[File:Korrelation_5_neu.png|frame|Gaußsche 2D-WDF mit Korrelationsgerade $K$]] | ||

| − | Ziel der linearen Regression ist es, einen einfachen (linearen) Zusammenhang zwischen zwei Zufallsgrößen $X$ und $Y$ | + | Ziel der linearen Regression ist es, einen einfachen (linearen) Zusammenhang zwischen zwei Zufallsgrößen $X$ und $Y$ anzugeben, deren $\text{2D-WDF}$ $f_{XY}(x, y)$ durch Punkte $(x_1, y_1 )$ ... $(x_N, y_N )$ in der $(x,\ y)$–Ebene vorgegeben ist. Die Skizze zeigt das Prinzip am Beispiel mittelwertfreier Größen: |

:Gesucht ist die Gleichung der Geraden $K$ ⇒ $y=c_{\rm opt} \cdot x$ mit der Eigenschaft, dass der mittlere quadratische (Euklidische) Abstand $\rm (MQA)$ aller Punkte von dieser Geraden minimal ist. Man bezeichnet diese Gerade auch als ''Korrelationsgerade''. Diese kann als eine Art „statistische Symmetrieachse“ interpretiert werden. | :Gesucht ist die Gleichung der Geraden $K$ ⇒ $y=c_{\rm opt} \cdot x$ mit der Eigenschaft, dass der mittlere quadratische (Euklidische) Abstand $\rm (MQA)$ aller Punkte von dieser Geraden minimal ist. Man bezeichnet diese Gerade auch als ''Korrelationsgerade''. Diese kann als eine Art „statistische Symmetrieachse“ interpretiert werden. | ||

Bei einer großen Menge $N$ empirischer Daten ist der mathematische Aufwand beträchtlich, den bestmöglichen Parameter $C = c_{\rm opt}$ zu ermitteln. Der Aufwand wird deutlich reduziert, wenn man den Abstand nur in $x$– oder in $y$–Richtung definiert. | Bei einer großen Menge $N$ empirischer Daten ist der mathematische Aufwand beträchtlich, den bestmöglichen Parameter $C = c_{\rm opt}$ zu ermitteln. Der Aufwand wird deutlich reduziert, wenn man den Abstand nur in $x$– oder in $y$–Richtung definiert. | ||

| − | Im Sonderfall Gaußscher 2D-Zufallsgrößen wie in der Skizze verwendet ist die Korrelationsgerade $K$ identisch mit der Ellipsenhauptachse bei Darstellung der 2D-WDF in Form von Höhenlinien. | + | Im Sonderfall Gaußscher 2D-Zufallsgrößen wie in der Skizze verwendet ist die Korrelationsgerade $K$ identisch mit der Ellipsenhauptachse bei Darstellung der 2D-WDF in Form von Höhenlinien (siehe [[Applets:Korrelation_und_Regressionsgerade#Der_Sonderfall_Gau.C3.9Fscher_2D.E2.80.93Zufallsgr.C3.B6.C3.9Fen|Abschnitt 2.3]]). |

$\text{(a)}\hspace{0.5cm} \text{Regressionsgerade }R_{Y \to X}$ (rote Gerade in der App) | $\text{(a)}\hspace{0.5cm} \text{Regressionsgerade }R_{Y \to X}$ (rote Gerade in der App) | ||

| − | Hier wird der $y$–Wert auf den $x$–Wert zurückgeführt, was in etwa einer der möglichen Bedeutungen | + | Hier wird der $y$–Wert auf den $x$–Wert zurückgeführt, was in etwa einer der möglichen Bedeutungen "Zurückfallen" des Wortes "Regression" entspricht. |

*'''Geradengleichung''', Winkel $\theta_{Y \to X}$ der Geraden $R_{Y \to X}$ zur $x$–Achse: | *'''Geradengleichung''', Winkel $\theta_{Y \to X}$ der Geraden $R_{Y \to X}$ zur $x$–Achse: | ||

| Line 161: | Line 122: | ||

*'''Geradengleichung''', Winkel $\theta_{X \to Y}$ der Geraden $R_{X \to Y}$ zur $x$–Achse: | *'''Geradengleichung''', Winkel $\theta_{X \to Y}$ der Geraden $R_{X \to Y}$ zur $x$–Achse: | ||

| − | :$$y=C_{X \to Y} \cdot x \ \ \text{mit} \ \ C_{X \to Y}=\frac{\ | + | :$$y=C_{X \to Y} \cdot x \ \ \text{mit} \ \ C_{X \to Y}=\frac{\sigma_Y}{\sigma_X\cdot\rho_{XY} }= \frac{\sigma_Y^2} {\mu_{XY}},\hspace{0.6cm} \theta_{X \to Y}={\rm arctan}\ (C_{X \to Y}).$$ |

*'''Kriterium''': Der mittlere Abstand aller Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{X \to Y}$ in $x$–Richtung ist minimal: | *'''Kriterium''': Der mittlere Abstand aller Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{X \to Y}$ in $x$–Richtung ist minimal: | ||

| − | :$${\rm MQA}_X = {\rm E} \big [ x_n - y_n/C_{ | + | :$${\rm MQA}_X = {\rm E} \big [ x_n - y_n/C_{X \to Y}\big ]^2 = \frac{\rm 1}{N} \cdot \sum_{n=\rm 1}^{N}\; \;\big [x_n - y_n/C_{X \to Y}\big ]^{\rm 2}={\rm Minimum}.$$ |

[[File:Korrelation_5a.png|right|frame| Die beiden Regressionsgeraden]] | [[File:Korrelation_5a.png|right|frame| Die beiden Regressionsgeraden]] | ||

| Line 169: | Line 130: | ||

$\text{Beispiel 2:}$ Es gelten die gleichen Voraussetzungen wie im $\text{Beispiel 1}$ und es werden teilweise auch die dort gefundenen Ergebnisse verwendet. | $\text{Beispiel 2:}$ Es gelten die gleichen Voraussetzungen wie im $\text{Beispiel 1}$ und es werden teilweise auch die dort gefundenen Ergebnisse verwendet. | ||

| − | In der oberen Grafik ist die Regressionsgerade $R_{ | + | In der oberen Grafik ist die Regressionsgerade $R_{X \to Y}$ als blaue Kurve eingezeichnet: |

| − | * Hierfür ergibt sich $C_{X \to Y}= | + | * Hierfür ergibt sich $C_{X \to Y}={\sigma_Y^2}/\mu_{XY} = 1$ und dementsprechend $ \theta_{X \to Y}={\rm arctan}\ (1) = 45^\circ.$ |

*Für den mittleren Abstand aller vier Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{X \to Y}$ in $x$–Richtung erhält man unter Ausnutzung der Symmetrie (beachten Sie die eingezeichneten blauen Horizontalen): | *Für den mittleren Abstand aller vier Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{X \to Y}$ in $x$–Richtung erhält man unter Ausnutzung der Symmetrie (beachten Sie die eingezeichneten blauen Horizontalen): | ||

:$${\rm MQA}_X = {\rm E} \big [ x_n - y_n/C_{x \to y}\big ]^2 = 2 \cdot \big [ 0.2 \cdot \left [1 - 1/1\right ]^{\rm 2} +0.3 \cdot \left [0.5 - 0/1\right ]^{\rm 2}\big ]=0.15.$$ | :$${\rm MQA}_X = {\rm E} \big [ x_n - y_n/C_{x \to y}\big ]^2 = 2 \cdot \big [ 0.2 \cdot \left [1 - 1/1\right ]^{\rm 2} +0.3 \cdot \left [0.5 - 0/1\right ]^{\rm 2}\big ]=0.15.$$ | ||

| Line 179: | Line 140: | ||

* Hierfür ergibt sich $C_{Y \to X}=\mu_{XY}/{\sigma_X^2} = 0.4/0.55\approx0.727$ und $ \theta_{Y \to X}={\rm arctan}\ (0.727) \approx 36^\circ.$ | * Hierfür ergibt sich $C_{Y \to X}=\mu_{XY}/{\sigma_X^2} = 0.4/0.55\approx0.727$ und $ \theta_{Y \to X}={\rm arctan}\ (0.727) \approx 36^\circ.$ | ||

*Hier ist nun der mittlere Abstand der vier Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{Y \to X}$ in $y$–Richtung minimal (beachten Sie die eingezeichneten roten Vertikalen): | *Hier ist nun der mittlere Abstand der vier Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{Y \to X}$ in $y$–Richtung minimal (beachten Sie die eingezeichneten roten Vertikalen): | ||

| − | :$${\rm MQA}_Y = {\rm E} \big [ y_n - C_{ | + | :$${\rm MQA}_Y = {\rm E} \big [ y_n - C_{Y \to X} \cdot x_n\big ]^2 = 2 \cdot \big [ 0.2 \cdot \left [1 - 0.727 \cdot 1\right ]^{\rm 2} +0.3 \cdot \left [0 - 0.727 \cdot 0.5 \right ]^{\rm 2}\big ]\approx 0.109.$$ |

| − | Die im Text erwähnte | + | Die im Text erwähnte "Korrelationsgerade" mit der Eigenschaft, dass der mittlere quadratische Euklidische Abstand $\rm (MQA)$ aller Punkte von dieser Geraden minimal ist, wird sicher zwischen den beiden hier berechneten Regressionsgeraden liegen.}} |

| − | === | + | ===Der Sonderfall Gaußscher 2D–Zufallsgrößen=== |

| − | + | Im Sonderfall einer mittelwertfreien [[Theory_of_Stochastic_Signals/Zweidimensionale_Gaußsche_Zufallsgrößen|Gaußschen 2–Zufallsgröße]] $(X,\ Y)$ lautet die Verbundwahrscheinlichkeitsdichtefunktion: | |

| − | [[File: | + | :$$f_{XY}(x,y)=\frac{\rm 1}{\rm 2\it\pi \cdot \sigma_X \cdot \sigma_Y \cdot \sqrt{\rm 1-\rho_{\it XY}^2}}\cdot\exp\Bigg[-\frac{\rm 1}{\rm 2 \cdot(1-\it\rho_{XY}^{\rm 2} {\rm)}}\cdot(\frac {\it x^{\rm 2}}{\sigma_X^{\rm 2}}+\frac {\it y^{\rm 2}}{\sigma_Y^{\rm 2}}-\rm 2\cdot\it\rho_{XY}\cdot\frac{x \cdot y}{\sigma_X \cdot \sigma_Y}\rm ) \rm \Bigg].$$ |

| + | *Ersetzt man $x$ durch $(x - m_X)$ sowie $y$ durch $(y- m_Y)$, so ergibt sich die allgemeinere WDF einer zweidimensionalen Gaußschen Zufallsgröße mit Mittelwert. | ||

| + | *Die beiden Randwahrscheinlichkeitsdichtefunktionen $f_{X}(x)$ und $f_{Y}(y)$ einer Gaußschen 2D-Zufallsgröße sind ebenfalls gaußförmig mit den Streuungen $σ_X$ bzw. $σ_Y$. | ||

| + | *Bei unkorrelierten Komponenten $X$ und $Y$ muss in obiger Gleichung $ρ_{XY} = 0$ eingesetzt werden, und man erhält dann das Ergebnis: | ||

| + | [[File:Korrelation_7a.png|right|frame| $K$, $R_{Y \to X}$ und $R_{X \to Y}$ bei Gaußschen 2D–Zufallsgrößen]] | ||

| + | :$$f_{XY}(x,y)=\frac{1}{\sqrt{2\pi}\cdot\sigma_{X}} \cdot\rm e^{-\it {x^{\rm 2}}\hspace{-0.08cm}/{\rm (}{\rm 2\it\sigma_{X}^{\rm 2}} {\rm )}} \cdot\frac{1}{\sqrt{2\pi}\cdot\sigma_{\it Y}}\cdot e^{-\it {y^{\rm 2}}\hspace{-0.08cm}/{\rm (}{\rm 2\it\sigma_{Y}^{\rm 2}} {\rm )}} = \it f_{X} \rm ( \it x \rm ) \cdot \it f_{Y} \rm ( \it y \rm ) .$$ | ||

| + | |||

| + | *Bei korrelierten Komponenten $X$ und $Y$ ⇒ $ρ_{XY} \ne 0$ sind die Höhenlinien der 2D-WDF jeweils ellipsenförmig. Die Korrelationsgerade $K$ ist hier identisch mit der Ellipsenhauptachse, die unter folgendem Neigungswinkel verläuft: | ||

| + | :$$\theta_{\rm K} = {1}/{2} \cdot {\rm arctan } \ ( 2 \cdot \rho_{XY} \cdot \frac {\sigma_X \cdot \sigma_Y}{\sigma_X^2 - \sigma_Y^2}).$$ | ||

| − | * | + | *Die (rote) Regressionsgerade $R_{Y \to X}$ einer Gaußschen 2D–Zufallsgröße liegt stets unterhalb der Korrelationsgeraden. Sie kann aus dem Schnittpunkt jeder elliptischen Höhenlinie und ihrer vertikalen Tangente geometrisch konstruiert werden. |

| − | * | + | * In der Skizze ist dieses Konstruktionsmerkmal in grüner Farbe angedeutet. Die (blaue) Regressionsgerade $R_{X \to Y}$ ist eine Gerade durch den Koordinatenursprung und den Schnittpunkt der elliptischen Höhenlinie mit ihrer horizontalen Tangente. |

| − | |||

| − | |||

<br clear=all> | <br clear=all> | ||

| − | + | ||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

==Versuchsdurchführung== | ==Versuchsdurchführung== | ||

| Line 208: | Line 167: | ||

*Wählen Sie zunächst die Nummer '''1''' ... '''6''' der zu bearbeitenden Aufgabe. | *Wählen Sie zunächst die Nummer '''1''' ... '''6''' der zu bearbeitenden Aufgabe. | ||

*Eine Aufgabenbeschreibung wird angezeigt. Die Parameterwerte sind angepasst. | *Eine Aufgabenbeschreibung wird angezeigt. Die Parameterwerte sind angepasst. | ||

| − | *Lösung nach Drücken von | + | *Lösung nach Drücken von "Musterlösung". |

| − | *Die Nummer '''0''' entspricht einem | + | *Die Nummer '''0''' entspricht einem "Reset": Gleiche Einstellung wie beim Programmstart. |

| Line 218: | Line 177: | ||

{{BlaueBox|TEXT= | {{BlaueBox|TEXT= | ||

| − | '''(1)''' Mit welcher Parametereinstellung sind die beiden | + | '''(1)''' Mit welcher Parametereinstellung sind die beiden Regressionsgeraden $R_{Y \to X}$ und $R_{X \to Y}$ deckungsgleich?}} |

| − | ::* Es ist offensichtlich, dass gleiche | + | ::* Es ist offensichtlich, dass gleiche Regressionsgeraden nur möglich sind, wenn diese unter dem Winkel $45^\circ$ verlaufen ⇒ "Winkelhalbierende". |

::* Da die fest vorgegebenen Punkte $3$ und $4$ auf der Winkelhalbierenden liegen, muss dies auch für die Punkte $1$ und $2$ gelten ⇒ $y_1 = x_1$. | ::* Da die fest vorgegebenen Punkte $3$ und $4$ auf der Winkelhalbierenden liegen, muss dies auch für die Punkte $1$ und $2$ gelten ⇒ $y_1 = x_1$. | ||

::* Dies gilt für alle Parametereinstellungen $y_1 = x_1$ und auch für alle $p_1$ im erlaubten Bereich von $0$ bis $0.5$. | ::* Dies gilt für alle Parametereinstellungen $y_1 = x_1$ und auch für alle $p_1$ im erlaubten Bereich von $0$ bis $0.5$. | ||

| Line 227: | Line 186: | ||

'''(2)''' Nun gelte $x_1 = 0.5,\ y_1 = 0,\ p_1 = 0.3$ Interpretieren Sie die Ergebnisse. Aktivieren Sie hierzu die Hilfsgerade. }} | '''(2)''' Nun gelte $x_1 = 0.5,\ y_1 = 0,\ p_1 = 0.3$ Interpretieren Sie die Ergebnisse. Aktivieren Sie hierzu die Hilfsgerade. }} | ||

| − | ::* Diese Einstellung stimmt mit den Voraussetzungen zu $\text{Beispiel 1}$ und $\text{Beispiel 2}$ überein. Insbesondere gilt $ \theta_{X \to Y}= 45^\circ | + | ::* Diese Einstellung stimmt mit den Voraussetzungen zu $\text{Beispiel 1}$ und $\text{Beispiel 2}$ überein. Insbesondere gilt $ \theta_{X \to Y}= 45^\circ$ und $ \theta_{Y \to X}\approx 36^\circ$. |

::* Durch Variation des Winkels $ \theta_{\rm HG}$ erkennt man, dass für $ \theta_{\rm HG}= 45^\circ$ die Kenngröße ${\rm MQA}_X =0.15$ tatsächlich den kleinsten Wert annimmt. | ::* Durch Variation des Winkels $ \theta_{\rm HG}$ erkennt man, dass für $ \theta_{\rm HG}= 45^\circ$ die Kenngröße ${\rm MQA}_X =0.15$ tatsächlich den kleinsten Wert annimmt. | ||

| − | ::* Ebenso ergibt sich der kleinstmögliche Abstand ${\rm MQA}_Y =0.109$ in $y$–Richtung für $ \theta_{\rm HG}= 36^\circ$, also entsprechend der Geraden $R_{ | + | ::* Ebenso ergibt sich der kleinstmögliche Abstand ${\rm MQA}_Y =0.109$ in $y$–Richtung für $ \theta_{\rm HG}= 36^\circ$, also entsprechend der Geraden $R_{Y \to X}$. |

{{BlaueBox|TEXT= | {{BlaueBox|TEXT= | ||

| Line 260: | Line 219: | ||

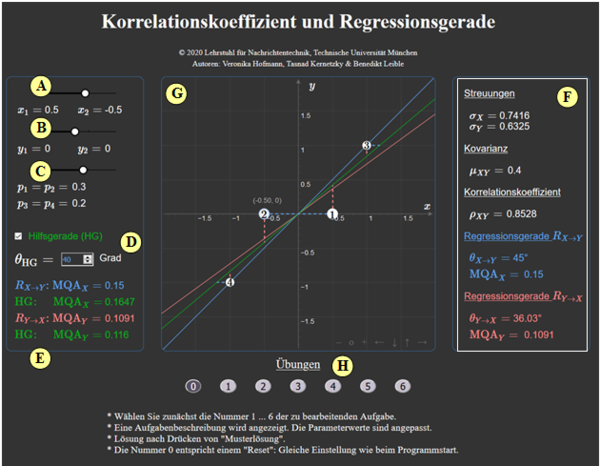

==Zur Handhabung des Applets== | ==Zur Handhabung des Applets== | ||

| − | [[File: | + | [[File:Anleitung_korrelation_version2.png|left|600px]] |

| − | '''(A)''' | + | <br><br><br><br><br> |

| + | '''(A)''' Einstellung der $x$–Koordinaten für '''(1)''' und '''(2)''' | ||

| − | '''(B)''' | + | '''(B)''' Einstellung der $y$–Koordinaten für '''(1)''' und '''(2)''' |

| − | '''(C)''' | + | '''(C)''' Einstellung der Wahrscheinlichkeiten aller Punkte |

| − | '''(D)''' | + | '''(D)''' Hilfsgerade mit Winkel $\theta_{\rm HG}$ einblenden |

| − | '''(E)''' | + | '''(E)''' Ausgabe der $\rm MQA$–Werte für Regressions– und Hilfsgerade |

| − | '''(F)''' | + | '''(F)''' Numerikausgabe der statistischen Kenngrößen |

| − | '''(G)''' | + | '''(G)''' Grafikbereich zur Darstellung der Regressionsgeraden |

| − | '''(H)''' | + | '''(H)''' Bereich für Übungen: Aufgabenauswahl, Fragen, Musterlösungen |

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

<br clear=all> | <br clear=all> | ||

| − | |||

| − | |||

| − | |||

| − | |||

==Über die Autoren== | ==Über die Autoren== | ||

Dieses interaktive Berechnungstool wurde am [http://www.lnt.ei.tum.de/startseite Lehrstuhl für Nachrichtentechnik] der [https://www.tum.de/ Technischen Universität München] konzipiert und realisiert. | Dieses interaktive Berechnungstool wurde am [http://www.lnt.ei.tum.de/startseite Lehrstuhl für Nachrichtentechnik] der [https://www.tum.de/ Technischen Universität München] konzipiert und realisiert. | ||

| − | *Die erste Version wurde 2005 von [[ | + | *Die erste Version wurde 2005 von [[Biographies_and_Bibliographies/An_LNTwww_beteiligte_Studierende#Bettina_Hirner_.28Diplomarbeit_LB_2005.29|Bettina Hirner]] im Rahmen ihrer Diplomarbeit mit "FlashMX–Actionscript" erstellt (Betreuer: [[Biographies_and_Bibliographies/An_LNTwww_beteiligte_Mitarbeiter_und_Dozenten#Prof._Dr.-Ing._habil._G.C3.BCnter_S.C3.B6der_.28am_LNT_seit_1974.29|Günter Söder]]). |

| − | *2020 wurde das Programm von [[Veronika Hofmann]] (Ingenieurspraxis Mathematik, Betreuer: [[Benedikt Leible]] und [[ | + | *2020 wurde das Programm von [[Biographies_and_Bibliographies/An_LNTwww_beteiligte_Studierende#Veronika_Hofmann_.28Ingenieurspraxis_Math_2020.29|Veronika Hofmann]] (Ingenieurspraxis Mathematik, Betreuer: [[Benedikt Leible]] und [[Biographies_and_Bibliographies/Beteiligte_der_Professur_Leitungsgebundene_%C3%9Cbertragungstechnik#Tasn.C3.A1d_Kernetzky.2C_M.Sc._.28bei_L.C3.9CT_seit_2014.29|Tasnád Kernetzky]] ) unter "HTML5" neu gestaltet. |

==Nochmalige Aufrufmöglichkeit des Applets in neuem Fenster== | ==Nochmalige Aufrufmöglichkeit des Applets in neuem Fenster== | ||

| − | {{LntAppletLink| | + | {{LntAppletLink|correlation}} |

Latest revision as of 16:46, 28 May 2021

Contents

Programmbeschreibung

Als einfaches Beispiel einer 2D-Zufallsgröße $(X, Y)$ betrachten wir den Fall, dass diese nur vier Werte annehmen kann:

- Punkt $1$ bei $(x_1, \ y_1)$ mit Wahrscheinlichkeit $p_1$: Die Parameter $x_1, \ y_1, \ p_1$ sind im Applet per Slider einstellbar.

- Punkt $2$ bei $(x_2, \ y_2)$ mit Wahrscheinlichkeit $p_2$: Die Parameter liegen durch den Punkt $1$ fest: $x_2=-x_1, \ y_2=-y_1, \ p_2=p_1$.

- Punkt $3$ bei $(+1, +1)$ mit Wahrscheinlichkeit $p_3 = 0.5-p_1$: Die Lage dieses Punktes ist im Applet fest vorgegeben.

- Punkt $4$ bei $(-1, -1)$ mit Wahrscheinlichkeit $p_4 = p_3$: Dieser Punkt liegt ebenso wie der Punkt $3$ auf der Winkelhalbierenden.

Für diese Konstellation werden im Applet folgende Gerade durch den Nullpunkt dargestellt:

- Die Regressionsgerade $R_{X \to Y}$ unter dem Winkel $\theta_{X \to Y}$ ⇒ blaue Kurve,

- die Regressionsgerade $R_{Y \to X}$ unter dem Winkel $\theta_{Y \to X}$ ⇒ rote Kurve,

- eine Hilfsgerade "$\rm (HG)$" unter dem Winkel $\theta_{\rm HG}$ ⇒ grüne Kurve, optional.

Als Zahlenwerte werden die zur Berechnung von $\theta_{X \to Y}$ und $\theta_{Y \to X}$ benötigten statistischen Kenngrößen ausgegeben:

- die Streuungen (Standardabweichungen) $\sigma_X$ und $\sigma_Y$ der Komponenten $X$ bzw. $Y$,

- die Kovarianz $\mu_{XY}$ ⇒ Zentralmoment erster Ordnung der 2D-Zufallsgröße $(X, Y)$,

- der Korrelationskoeffizient $\rho_{XY}$ zwischen den 2D-Zufallsgröße $X$ und $Y$.

Mit Hilfe der (optionalen) Hilfsgeraden sowie der gestrichelt eingezeichneten Abstände der Punkte in $x$– und $y$–Richtung zu dieser lässt sich nachvollziehen, dass

- die rote Regressionsgerade $R_{X \to Y}$ die Eigenschaft hat, dass der mittlere quadrische Abstand aller Punkte in $y$–Richtung ⇒ ${\rm MQA}_Y$ von dieser minimal ist,

- während für die blaue Regressionsgerade $R_{Y \to X}$ der mittlere quadrische Abstand aller Punkte in $x$–Richtung ⇒ ${\rm MQA}_X$ zum Minimum führt.

Theoretischer Hintergrund

Erwartungswerte von 2D–Zufallsgrößen und Korrelationskoeffizient

Wir betrachten eine zweidimensionale $\rm (2D)$–Zufallsgröße $(X,\ Y)$ mit der Wahrscheinlichkeitsdichtefunktion $\rm (WDF)$ $f_{XY}(x, y)$, wobei zwischen den Einzelkomponenten $X$ und $Y$ statistische Abhängigkeiten bestehen. Ein Sonderfall ist die Korrelation.

$\text{Definition:}$ Unter Korrelation versteht man eine lineare Abhängigkeit zwischen den Einzelkomponenten $X$ und $Y$.

- Korrelierte Zufallsgrößen sind damit stets auch statistisch abhängig.

- Aber nicht jede statistische Abhängigkeit bedeutet gleichzeitig eine Korrelation.

Für das Folgende setzen wir voraus, dass $X$ und $Y$ mittelwertfrei seien ⇒ ${\rm E}\big [ X \big ] = {\rm E}\big [ Y \big ]=0$. Zur Beschreibung der Korrelation genügen dann folgende Erwartungswerte:

- die Varianzen in $X$– bzw. in $Y$–Richtung:

- $$\sigma_X^2= {\rm E}\big [ X^2 \big ] = \int_{-\infty}^{+\infty}\hspace{0.2cm}x^2 \cdot f_{X}(x) \, {\rm d}x\hspace{0.05cm},\hspace{0.5cm}\sigma_Y^2= {\rm E}\big [Y^2 \big ] = \int_{-\infty}^{+\infty}\hspace{0.2cm}y^2 \cdot f_{Y}(y) \, {\rm d}y\hspace{0.05cm};$$

- die Kovarianz zwischen den Einzelkomponenten $X$ und $Y$:

- $$\mu_{XY}= {\rm E}\big [ X \cdot Y \big ] = \int_{-\infty}^{+\infty}\hspace{0.2cm}\int_{-\infty}^{+\infty} x\ \cdot y \cdot f_{XY}(x,y) \, {\rm d}x\, {\rm d}y\hspace{0.05cm}.$$

Bei statistischer Unabhängigkeit der beiden Komponenten $X$ und $Y$ ist die Kovarianz $\mu_{XY} \equiv 0$.

- Das Ergebnis $\mu_{XY} = 0$ ist auch bei statistisch abhängigen Komponenten $X$ und $Y$ möglich, nämlich dann, wenn diese unkorreliert, also linear unabhängig sind.

- Die statistische Abhängigkeit ist dann nicht von erster, sondern von höherer Ordnung, zum Beispiel entsprechend der Gleichung $Y=X^2.$

Man spricht dann von vollständiger Korrelation, wenn die (deterministische) Abhängigkeit zwischen $X$ und $Y$ durch die Gleichung $Y = K · X$ ausgedrückt wird.

Dann ergibt sich für die Kovarianz:

- $\mu_{XY} = σ_X · σ_Y$ bei positivem Wert von $K$,

- $\mu_{XY} = -σ_X · σ_Y$ bei negativem $K$–Wert.

Deshalb verwendet man häufig als Beschreibungsgröße anstelle der Kovarianz den so genannten Korrelationskoeffizienten.

$\text{Definition:}$ Der Korrelationskoeffizient ist der Quotient aus der Kovarianz $\mu_{XY}$ und dem Produkt der Effektivwerte $σ_X$ und $σ_Y$ der beiden Komponenten:

- $$\rho_{XY}=\frac{\mu_{XY} } {\sigma_X \cdot \sigma_Y}.$$

Der Korrelationskoeffizient $\rho_{XY}$ weist folgende Eigenschaften auf:

- Aufgrund der Normierung gilt stets $-1 \le ρ_{XY} ≤ +1$.

- Sind die beiden Zufallsgrößen $X$ und $Y$ unkorreliert, so ist $ρ_{XY} = 0$.

- Bei strenger linearer Abhängigkeit zwischen $X$ und $Y$ ist $ρ_{XY}= ±1$ ⇒ vollständige Korrelation.

- Ein positiver Korrelationskoeffizient bedeutet, dass bei größerem $X$–Wert im statistischen Mittel auch $Y$ größer ist als bei kleinerem $X$.

- Dagegen drückt ein negativer Korrelationskoeffizient aus, dass $Y$ mit steigendem $X$ im Mittel kleiner wird.

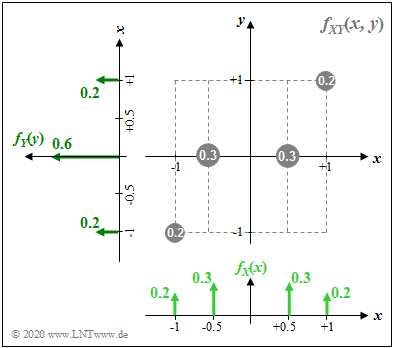

$\text{Beispiel 1:}$ Die 2D–Zufallsgröße $(X,\ Y)$ sei diskret und kann nur vier verschiedene Werte annehmen:

- $(+0.5,\ 0)$ sowie $(-0.5,\ 0)$ jeweils mit der Wahrscheinlichkeit $0.3$,

- $(+1,\ +\hspace{-0.09cm}1)$ sowie $(-1,\ -\hspace{-0.09cm}1)$ jeweils mit der Wahrscheinlichkeit $0.2$.

$\rm (A)$ Die Varianzen bzw. die Streuungen können aus $f_{X}(x)$ und $f_{Y}(y)$ berechnet werden:

- $$\sigma_X^2 = 2 \cdot \big [0.2 \cdot 1^2 + 0.3 \cdot 0.5^2 \big] = 0.55\hspace{0.3cm}\Rightarrow\hspace{0.3cm}\sigma_X = 0.7416,$$

- $$\sigma_Y^2 = \big [0.2 \cdot (-1)^2 + 0.6 \cdot 0^2 +0.2 \cdot (+1)^2 \big] = 0.4\hspace{0.3cm}\Rightarrow\hspace{0.3cm}\sigma_Y = 0.6325.$$

$\rm (B)$ Für die Kovarianz ergibt sich der folgende Erwartungswert:

- $$\mu_{XY}= {\rm E}\big [ X \cdot Y \big ] = 2 \cdot \big [0.2 \cdot 1 \cdot 1 + 0.3 \cdot 0.5 \cdot 0 \big] = 0.4.$$

$\rm (C)$ Damit erhält man für den Korrelationskoeffizienten:

- $$\rho_{XY}=\frac{\mu_{XY} } {\sigma_X \cdot \sigma_Y}=\frac{0.4 } {0.7416 \cdot 0.6325 }\approx 0.8528. $$

Eigenschaften der Regressionsgeraden

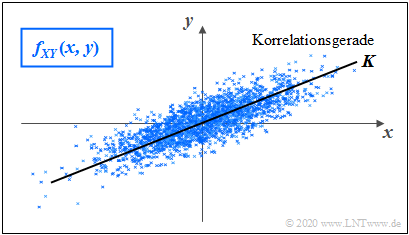

Ziel der linearen Regression ist es, einen einfachen (linearen) Zusammenhang zwischen zwei Zufallsgrößen $X$ und $Y$ anzugeben, deren $\text{2D-WDF}$ $f_{XY}(x, y)$ durch Punkte $(x_1, y_1 )$ ... $(x_N, y_N )$ in der $(x,\ y)$–Ebene vorgegeben ist. Die Skizze zeigt das Prinzip am Beispiel mittelwertfreier Größen:

- Gesucht ist die Gleichung der Geraden $K$ ⇒ $y=c_{\rm opt} \cdot x$ mit der Eigenschaft, dass der mittlere quadratische (Euklidische) Abstand $\rm (MQA)$ aller Punkte von dieser Geraden minimal ist. Man bezeichnet diese Gerade auch als Korrelationsgerade. Diese kann als eine Art „statistische Symmetrieachse“ interpretiert werden.

Bei einer großen Menge $N$ empirischer Daten ist der mathematische Aufwand beträchtlich, den bestmöglichen Parameter $C = c_{\rm opt}$ zu ermitteln. Der Aufwand wird deutlich reduziert, wenn man den Abstand nur in $x$– oder in $y$–Richtung definiert.

Im Sonderfall Gaußscher 2D-Zufallsgrößen wie in der Skizze verwendet ist die Korrelationsgerade $K$ identisch mit der Ellipsenhauptachse bei Darstellung der 2D-WDF in Form von Höhenlinien (siehe Abschnitt 2.3).

$\text{(a)}\hspace{0.5cm} \text{Regressionsgerade }R_{Y \to X}$ (rote Gerade in der App)

Hier wird der $y$–Wert auf den $x$–Wert zurückgeführt, was in etwa einer der möglichen Bedeutungen "Zurückfallen" des Wortes "Regression" entspricht.

- Geradengleichung, Winkel $\theta_{Y \to X}$ der Geraden $R_{Y \to X}$ zur $x$–Achse:

- $$y=C_{Y \to X} \cdot x \ \ \ \text{mit} \ \ \ C_{Y \to X}=\frac{\sigma_Y}{\sigma_X}\cdot\rho_{XY}= \frac{\mu_{XY}}{\sigma_X^2},\hspace{0.6cm} \theta_{Y \to X}={\rm arctan}\ (C_{Y \to X}).$$

- Kriterium: Der mittlere Abstand aller Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{Y \to X}$ in $y$–Richtung ist minimal:

- $${\rm MQA}_Y = {\rm E} \big [ y_n - C_{Y \to X} \cdot x_n\big ]^2 = \frac{\rm 1}{N} \cdot \sum_{n=\rm 1}^{N}\; \;\big [y_n - C_{Y \to X} \cdot x_n\big ]^{\rm 2}={\rm Minimum}.$$

- Die zweite Gleichung gilt nur, wenn alle Punkte $(x_n, y_n )$ der 2D–WDF gleichwahrscheinlich sind.

$\text{(b)}\hspace{0.5cm} \text{Regressionsgerade }R_{X \to Y}$ (blaue Gerade in der App)

Die Regression in Gegenrichtung $($also von $X$ auf $Y)$ bedeutet dagegen, dass der $x$–Wert auf den $y$–Wert zurückgeführt wird. Für ${\rm MQA}_X$ ergibt sich der minimale Wert.

- Geradengleichung, Winkel $\theta_{X \to Y}$ der Geraden $R_{X \to Y}$ zur $x$–Achse:

- $$y=C_{X \to Y} \cdot x \ \ \text{mit} \ \ C_{X \to Y}=\frac{\sigma_Y}{\sigma_X\cdot\rho_{XY} }= \frac{\sigma_Y^2} {\mu_{XY}},\hspace{0.6cm} \theta_{X \to Y}={\rm arctan}\ (C_{X \to Y}).$$

- Kriterium: Der mittlere Abstand aller Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{X \to Y}$ in $x$–Richtung ist minimal:

- $${\rm MQA}_X = {\rm E} \big [ x_n - y_n/C_{X \to Y}\big ]^2 = \frac{\rm 1}{N} \cdot \sum_{n=\rm 1}^{N}\; \;\big [x_n - y_n/C_{X \to Y}\big ]^{\rm 2}={\rm Minimum}.$$

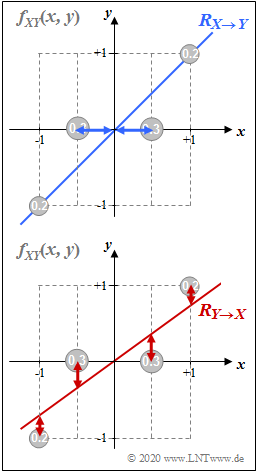

$\text{Beispiel 2:}$ Es gelten die gleichen Voraussetzungen wie im $\text{Beispiel 1}$ und es werden teilweise auch die dort gefundenen Ergebnisse verwendet.

In der oberen Grafik ist die Regressionsgerade $R_{X \to Y}$ als blaue Kurve eingezeichnet:

- Hierfür ergibt sich $C_{X \to Y}={\sigma_Y^2}/\mu_{XY} = 1$ und dementsprechend $ \theta_{X \to Y}={\rm arctan}\ (1) = 45^\circ.$

- Für den mittleren Abstand aller vier Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{X \to Y}$ in $x$–Richtung erhält man unter Ausnutzung der Symmetrie (beachten Sie die eingezeichneten blauen Horizontalen):

- $${\rm MQA}_X = {\rm E} \big [ x_n - y_n/C_{x \to y}\big ]^2 = 2 \cdot \big [ 0.2 \cdot \left [1 - 1/1\right ]^{\rm 2} +0.3 \cdot \left [0.5 - 0/1\right ]^{\rm 2}\big ]=0.15.$$

- Jede Gerade mit einem anderen Winkel als $45^\circ$ führt hier zu einem größeren ${\rm MQA}_X$.

Betrachten wir nun die rote Regressionsgerade $R_{Y \to X}$ in der unteren Grafik.

- Hierfür ergibt sich $C_{Y \to X}=\mu_{XY}/{\sigma_X^2} = 0.4/0.55\approx0.727$ und $ \theta_{Y \to X}={\rm arctan}\ (0.727) \approx 36^\circ.$

- Hier ist nun der mittlere Abstand der vier Punkte $(x_n, y_n )$ von der Regressionsgeraden $R_{Y \to X}$ in $y$–Richtung minimal (beachten Sie die eingezeichneten roten Vertikalen):

- $${\rm MQA}_Y = {\rm E} \big [ y_n - C_{Y \to X} \cdot x_n\big ]^2 = 2 \cdot \big [ 0.2 \cdot \left [1 - 0.727 \cdot 1\right ]^{\rm 2} +0.3 \cdot \left [0 - 0.727 \cdot 0.5 \right ]^{\rm 2}\big ]\approx 0.109.$$

Die im Text erwähnte "Korrelationsgerade" mit der Eigenschaft, dass der mittlere quadratische Euklidische Abstand $\rm (MQA)$ aller Punkte von dieser Geraden minimal ist, wird sicher zwischen den beiden hier berechneten Regressionsgeraden liegen.

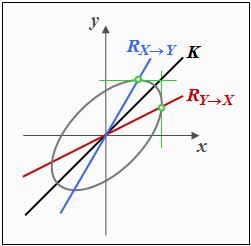

Der Sonderfall Gaußscher 2D–Zufallsgrößen

Im Sonderfall einer mittelwertfreien Gaußschen 2–Zufallsgröße $(X,\ Y)$ lautet die Verbundwahrscheinlichkeitsdichtefunktion:

- $$f_{XY}(x,y)=\frac{\rm 1}{\rm 2\it\pi \cdot \sigma_X \cdot \sigma_Y \cdot \sqrt{\rm 1-\rho_{\it XY}^2}}\cdot\exp\Bigg[-\frac{\rm 1}{\rm 2 \cdot(1-\it\rho_{XY}^{\rm 2} {\rm)}}\cdot(\frac {\it x^{\rm 2}}{\sigma_X^{\rm 2}}+\frac {\it y^{\rm 2}}{\sigma_Y^{\rm 2}}-\rm 2\cdot\it\rho_{XY}\cdot\frac{x \cdot y}{\sigma_X \cdot \sigma_Y}\rm ) \rm \Bigg].$$

- Ersetzt man $x$ durch $(x - m_X)$ sowie $y$ durch $(y- m_Y)$, so ergibt sich die allgemeinere WDF einer zweidimensionalen Gaußschen Zufallsgröße mit Mittelwert.

- Die beiden Randwahrscheinlichkeitsdichtefunktionen $f_{X}(x)$ und $f_{Y}(y)$ einer Gaußschen 2D-Zufallsgröße sind ebenfalls gaußförmig mit den Streuungen $σ_X$ bzw. $σ_Y$.

- Bei unkorrelierten Komponenten $X$ und $Y$ muss in obiger Gleichung $ρ_{XY} = 0$ eingesetzt werden, und man erhält dann das Ergebnis:

- $$f_{XY}(x,y)=\frac{1}{\sqrt{2\pi}\cdot\sigma_{X}} \cdot\rm e^{-\it {x^{\rm 2}}\hspace{-0.08cm}/{\rm (}{\rm 2\it\sigma_{X}^{\rm 2}} {\rm )}} \cdot\frac{1}{\sqrt{2\pi}\cdot\sigma_{\it Y}}\cdot e^{-\it {y^{\rm 2}}\hspace{-0.08cm}/{\rm (}{\rm 2\it\sigma_{Y}^{\rm 2}} {\rm )}} = \it f_{X} \rm ( \it x \rm ) \cdot \it f_{Y} \rm ( \it y \rm ) .$$

- Bei korrelierten Komponenten $X$ und $Y$ ⇒ $ρ_{XY} \ne 0$ sind die Höhenlinien der 2D-WDF jeweils ellipsenförmig. Die Korrelationsgerade $K$ ist hier identisch mit der Ellipsenhauptachse, die unter folgendem Neigungswinkel verläuft:

- $$\theta_{\rm K} = {1}/{2} \cdot {\rm arctan } \ ( 2 \cdot \rho_{XY} \cdot \frac {\sigma_X \cdot \sigma_Y}{\sigma_X^2 - \sigma_Y^2}).$$

- Die (rote) Regressionsgerade $R_{Y \to X}$ einer Gaußschen 2D–Zufallsgröße liegt stets unterhalb der Korrelationsgeraden. Sie kann aus dem Schnittpunkt jeder elliptischen Höhenlinie und ihrer vertikalen Tangente geometrisch konstruiert werden.

- In der Skizze ist dieses Konstruktionsmerkmal in grüner Farbe angedeutet. Die (blaue) Regressionsgerade $R_{X \to Y}$ ist eine Gerade durch den Koordinatenursprung und den Schnittpunkt der elliptischen Höhenlinie mit ihrer horizontalen Tangente.

Versuchsdurchführung

- Wählen Sie zunächst die Nummer 1 ... 6 der zu bearbeitenden Aufgabe.

- Eine Aufgabenbeschreibung wird angezeigt. Die Parameterwerte sind angepasst.

- Lösung nach Drücken von "Musterlösung".

- Die Nummer 0 entspricht einem "Reset": Gleiche Einstellung wie beim Programmstart.

In den folgenden Aufgabenbeschreibungen werden folgende Kurzbezeichnungen verwendet:

- Rot: Regressionsgerade $R_{Y \to X}$ (im Applet rot gezeichnet),

- Blau: Regressionsgerade $R_{X \to Y}$ (im Applet blau gezeichnet).

(1) Mit welcher Parametereinstellung sind die beiden Regressionsgeraden $R_{Y \to X}$ und $R_{X \to Y}$ deckungsgleich?

- Es ist offensichtlich, dass gleiche Regressionsgeraden nur möglich sind, wenn diese unter dem Winkel $45^\circ$ verlaufen ⇒ "Winkelhalbierende".

- Da die fest vorgegebenen Punkte $3$ und $4$ auf der Winkelhalbierenden liegen, muss dies auch für die Punkte $1$ und $2$ gelten ⇒ $y_1 = x_1$.

- Dies gilt für alle Parametereinstellungen $y_1 = x_1$ und auch für alle $p_1$ im erlaubten Bereich von $0$ bis $0.5$.

(2) Nun gelte $x_1 = 0.5,\ y_1 = 0,\ p_1 = 0.3$ Interpretieren Sie die Ergebnisse. Aktivieren Sie hierzu die Hilfsgerade.

- Diese Einstellung stimmt mit den Voraussetzungen zu $\text{Beispiel 1}$ und $\text{Beispiel 2}$ überein. Insbesondere gilt $ \theta_{X \to Y}= 45^\circ$ und $ \theta_{Y \to X}\approx 36^\circ$.

- Durch Variation des Winkels $ \theta_{\rm HG}$ erkennt man, dass für $ \theta_{\rm HG}= 45^\circ$ die Kenngröße ${\rm MQA}_X =0.15$ tatsächlich den kleinsten Wert annimmt.

- Ebenso ergibt sich der kleinstmögliche Abstand ${\rm MQA}_Y =0.109$ in $y$–Richtung für $ \theta_{\rm HG}= 36^\circ$, also entsprechend der Geraden $R_{Y \to X}$.

(3) Es gelten zunächst weiter die Einstellungen von (2). Wie ändern sich die Ergebnisse nach Variation von $p_1$ im erlaubten Bereich $(0\le p_1 \le 0.5)$?

- Die blaue Regressionsgerade $ R_{X \to Y}$ verläuft weiter unter dem Winkel $ \theta_{X \to Y}= 45^\circ$ ⇒ es gilt hier $\mu_{XY} =\sigma_Y^2$, und zwar unabhängig von $p_1 < 0.5$.

- Im Grenzfall $p_1 = 0.5$ ist wegen $\sigma_Y =0$ die blaue Regressionsgerade undefiniert. Es handelt sich nurmehr um eine 1D–Zufallsgröße $X$.

- Mit $p_1=0$ sind nur die äußeren Punkte $3$ und $4$ wirksam ⇒ $ \theta_{Y \to X}= \theta_{X \to Y}= 45^\circ$, mit $p_1=0.5$ nur die inneren Punkte ⇒ $ \theta_{Y \to X}= 0^\circ$.

- Dazwischen wird $ R_{Y \to X}$ kontinuierlich flacher. Sind alle Punkte gleichwahrscheinlich $(p_1=0.25)$, dann ist $\theta_{Y \to X}\approx 38.7^\circ$.

(4) Nun gelte $x_1 = 0,\ y_1 = 0.5,\ p_1 = 0.3$. Variieren Sie $0\le p_1 < 0.5$ und interpretieren Sie die Ergebnisse. $(p_1 = 0.5$ sollte man ausschließen$)$.

- Wegen $\sigma_X \le \sigma_Y$ liegt weiterhin die blaue Gerade nie unterhalb der roten, die für alle $p_1 \ne 0.5$ die Winkelhalbierende ist ⇒ $ \theta_{Y \to X}\approx 45^\circ$.

- Der Winkel der blauen Regressionsgerade wächst von $ \theta_{X \to Y}= 45^\circ \ (p_1 = 0)$ bis $ \theta_{X \to Y} \to 90^\circ \ (p_1 \to 0.5)$ kontinuierlich an.

(5) Beginnen Sie mit $x_1 = 0.8,\ y_1 = -0.8,\ p_1 = 0.25$ und vergrößern Sie $y_1$ bis zum Endwert $y_1 = +0.8$. Interpretieren Sie die Ergebnisse.

- Für $y_1 =-0.8$ ist $ \theta_{X \to Y}= 77.6^\circ$ und $ \theta_{Y \to X}= 12.4^\circ$. Mit steigendem $y_1$ verläuft $ R_{X \to Y}$ (blau) flacher und $R_{Y \to X}$ (rot) steiler.

- Im Endpunkt $(y_1 = +0.8)$ verlaufen die beiden Regressionsgeraden deckungsgleich unter dem Winkel $ \theta_{X \to Y}= \theta_{Y \to X}= 45^\circ$.

(6) Abschließend gelte $x_1 = +1,\ y_1 = -1$. Variieren Sie $p_1$ im gesamten zulässigen Bereich $0\le p_1 \le 0.5$. Wann sind $X$ und $Y$ unkorreliert?

- Für $p_1 = 0$ gilt $ \theta_{X \to Y}=\theta_{Y \to X}= 45^\circ.$ Dann dreht die blaue Gerade entgegen dem Uhrzeigersinn, die rote Gerade im Uhrzeigersinn.

- Für $p_1 = 0.25$ sind die Winkel $ \theta_{X \to Y}=90^\circ, \ \theta_{Y \to X}= 0^\circ.$ Diese Momentaufnahme beschreibt unkorrelierte Zufallsgrößen ⇒ $\mu_{XY}=0$.

- Anschließend drehen beide Geraden weiter in gleicher Richtung. Für $p_1 = 0.5$ gilt schließlich: $ \theta_{X \to Y}=135^\circ= -45^\circ, \ \theta_{Y \to X}= -45^\circ.$

Zur Handhabung des Applets

(A) Einstellung der $x$–Koordinaten für (1) und (2)

(B) Einstellung der $y$–Koordinaten für (1) und (2)

(C) Einstellung der Wahrscheinlichkeiten aller Punkte

(D) Hilfsgerade mit Winkel $\theta_{\rm HG}$ einblenden

(E) Ausgabe der $\rm MQA$–Werte für Regressions– und Hilfsgerade

(F) Numerikausgabe der statistischen Kenngrößen

(G) Grafikbereich zur Darstellung der Regressionsgeraden

(H) Bereich für Übungen: Aufgabenauswahl, Fragen, Musterlösungen

Über die Autoren

Dieses interaktive Berechnungstool wurde am Lehrstuhl für Nachrichtentechnik der Technischen Universität München konzipiert und realisiert.

- Die erste Version wurde 2005 von Bettina Hirner im Rahmen ihrer Diplomarbeit mit "FlashMX–Actionscript" erstellt (Betreuer: Günter Söder).

- 2020 wurde das Programm von Veronika Hofmann (Ingenieurspraxis Mathematik, Betreuer: Benedikt Leible und Tasnád Kernetzky ) unter "HTML5" neu gestaltet.