Difference between revisions of "Aufgaben:Exercise 4.4: Conventional Entropy and Differential Entropy"

m (Textersetzung - „\*\s*Sollte die Eingabe des Zahlenwertes „0” erforderlich sein, so geben Sie bitte „0\.” ein.“ durch „ “) |

|||

| Line 3: | Line 3: | ||

}} | }} | ||

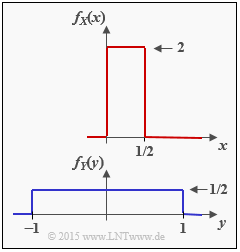

| − | [[File:P_ID2878__Inf_A_4_4.png|right|frame| | + | [[File:P_ID2878__Inf_A_4_4.png|right|frame|Zweimal Gleichverteilung]] |

Wir betrachten die zwei wertkontinuierlichen Zufallsgrößen $X$ und $Y$ mit den Wahrscheinlichkeitsdichtefunktionen $f_X(x)$ und $f_Y(y)$. Für diese Zufallsgrößen kann man | Wir betrachten die zwei wertkontinuierlichen Zufallsgrößen $X$ und $Y$ mit den Wahrscheinlichkeitsdichtefunktionen $f_X(x)$ und $f_Y(y)$. Für diese Zufallsgrößen kann man | ||

* die herkömmlichen Entropien $H(X)$ bzw. $H(Y)$ nicht angeben, | * die herkömmlichen Entropien $H(X)$ bzw. $H(Y)$ nicht angeben, | ||

| Line 10: | Line 10: | ||

Wir betrachten außerdem zwei wertdiskrete Zufallsgrößen: | Wir betrachten außerdem zwei wertdiskrete Zufallsgrößen: | ||

| − | *Die Zufallsgröße $Z_{X,\hspace{0.05cm}M}$ ergibt sich durch (geeignete) Quantisierung der Zufallsgröße $X$ mit der Quantisierungsstufenzahl $N$ ⇒ Quantisierungsintervallbreite ${\it Delta} = 0.5/M$. | + | *Die Zufallsgröße $Z_{X,\hspace{0.05cm}M}$ ergibt sich durch (geeignete) Quantisierung der Zufallsgröße $X$ mit der Quantisierungsstufenzahl $N$ ⇒ Quantisierungsintervallbreite ${\it \Delta} = 0.5/M$. |

| − | * Die Zufallsgröße $Z_{Y,\hspace{0.05cm}M}$ ergibt sich nach Quantisierung der | + | * Die Zufallsgröße $Z_{Y,\hspace{0.05cm}M}$ ergibt sich nach Quantisierung der Zufallsgröße $Y$ mit der Quantisierungsstufenzahl $M$ ⇒ Quantisierungsintervallbreite ${\it \Delta} = 2/M$. |

| − | Die Wahrscheinlichkeitsdichtefunktionen dieser diskreten Zufallsgrößen setzen sich jeweils aus $M$ Diracfunktionen zusammen, deren Impulsgewichte durch die Intervallflächen der zugehörigen wertkontinuierlichen Zufallsgrößen gegeben sind | + | Die Wahrscheinlichkeitsdichtefunktionen dieser diskreten Zufallsgrößen setzen sich jeweils aus $M$ Diracfunktionen zusammen, deren Impulsgewichte durch die Intervallflächen der zugehörigen wertkontinuierlichen Zufallsgrößen gegeben sind. |

| − | Im Abschnitt [[Informationstheorie/Differentielle_Entropie#Entropie_wertkontinuierlicher_Zufallsgr.C3.B6.C3.9Fen_nach_Quantisierung| | + | Daraus lassen sich die Entropien $H(Z_{X,\hspace{0.05cm}M})$ und $H(Z_{Y,\hspace{0.05cm}M})$ in herkömmlicher Weise entsprechend dem Kapitel [[Informationstheorie/Einige_Vorbemerkungen_zu_zweidimensionalen_Zufallsgrößen#Wahrscheinlichkeitsfunktion_und_Entropie|Wahrscheinlichkeitsfunktion und Entropie]] bestimmen. |

| + | |||

| + | Im Abschnitt [[Informationstheorie/Differentielle_Entropie#Entropie_wertkontinuierlicher_Zufallsgr.C3.B6.C3.9Fen_nach_Quantisierung|Entropie wertkontinuierlicher Zufallsgrößen nach Quantisierung]] wurde auch eine Näherung angegeben. Beispielsweise gilt: | ||

:$$H(Z_{X, \hspace{0.05cm}M}) \approx -{\rm log}_2 \hspace{0.1cm} ({\it \Delta}) + h(X)\hspace{0.05cm}. $$ | :$$H(Z_{X, \hspace{0.05cm}M}) \approx -{\rm log}_2 \hspace{0.1cm} ({\it \Delta}) + h(X)\hspace{0.05cm}. $$ | ||

*Sie werden im Laufe der Aufgabe feststellen, dass bei rechteckförmiger WDF ⇒ Gleichverteilung diese „Näherung” genau das gleiche Ergebnis liefert wie die direkte Berechnung. | *Sie werden im Laufe der Aufgabe feststellen, dass bei rechteckförmiger WDF ⇒ Gleichverteilung diese „Näherung” genau das gleiche Ergebnis liefert wie die direkte Berechnung. | ||

| − | *Aber im allgemeinen Fall – so im [[Informationstheorie/Differentielle_Entropie#Entropie_wertkontinuierlicher_Zufallsgr.C3.B6.C3.9Fen_nach_Quantisierung|Beispiel 2 mit dreieckförmiger WDF]] – stellt obige Gleichung tatsächlich nur eine Näherung dar, die erst im Grenzfall ${\it Delta} \to 0$ mit der tatsächlichen Entropie $H(Z_{X,\hspace{0.05cm}M})$ übereinstimmt. | + | *Aber im allgemeinen Fall – so im [[Informationstheorie/Differentielle_Entropie#Entropie_wertkontinuierlicher_Zufallsgr.C3.B6.C3.9Fen_nach_Quantisierung|Beispiel 2 mit dreieckförmiger WDF]] – stellt obige Gleichung tatsächlich nur eine Näherung dar, die erst im Grenzfall ${\it \Delta} \to 0$ mit der tatsächlichen Entropie $H(Z_{X,\hspace{0.05cm}M})$ übereinstimmt. |

| + | |||

| + | |||

| + | |||

| + | |||

''Hinweise:'' | ''Hinweise:'' | ||

*Die Aufgabe gehört zum Kapitel [[Informationstheorie/Differentielle_Entropie|Differentielle Entropie]]. | *Die Aufgabe gehört zum Kapitel [[Informationstheorie/Differentielle_Entropie|Differentielle Entropie]]. | ||

| − | *Nützliche Hinweise zur Lösung dieser Aufgabe finden Sie insbesondere auf der Seite [[Informationstheorie/Differentielle_Entropie#Entropie_wertkontinuierlicher_Zufallsgr.C3.B6.C3.9Fen_nach_Quantisierung| | + | *Nützliche Hinweise zur Lösung dieser Aufgabe finden Sie insbesondere auf der Seite [[Informationstheorie/Differentielle_Entropie#Entropie_wertkontinuierlicher_Zufallsgr.C3.B6.C3.9Fen_nach_Quantisierung|Entropie wertkontinuierlicher Zufallsgrößen nach Quantisierung]] . |

| Line 41: | Line 47: | ||

$ h(Y) \ = \ $ { 1 3% } $\ \rm bit$ | $ h(Y) \ = \ $ { 1 3% } $\ \rm bit$ | ||

| − | {Berechnen Sie die Entropie der wertdiskreten Zufallsgrößen $Z_{X,\hspace{0.05cm}M=4}$ nach der | + | {Berechnen Sie die Entropie der wertdiskreten Zufallsgrößen $Z_{X,\hspace{0.05cm}M=4}$ <u>nach der direkten Methode</u>. |

|type="{}"} | |type="{}"} | ||

$H(Z_{X,\hspace{0.05cm}M=4})\ = \ $ { 2 3% } $\ \rm bit$ | $H(Z_{X,\hspace{0.05cm}M=4})\ = \ $ { 2 3% } $\ \rm bit$ | ||

| − | {Berechnen Sie die Entropie der wertdiskreten Zufallsgrößen $Z_{X,\hspace{0.05cm}M=4}$ mit der | + | {Berechnen Sie die Entropie der wertdiskreten Zufallsgrößen $Z_{X,\hspace{0.05cm}M=4}$ <u>mit der angegebenen Näherung</u>. |

|type="{}"} | |type="{}"} | ||

$H(Z_{X,\hspace{0.05cm}M=4})\ = \ $ { 2 3% } $\ \rm bit$ | $H(Z_{X,\hspace{0.05cm}M=4})\ = \ $ { 2 3% } $\ \rm bit$ | ||

| − | {Berechnen Sie die Entropie der wertdiskreten Zufallsgröße $Z_{Y,\hspace{0.05cm}M=4}$ mit der angegebenen Näherung. | + | {Berechnen Sie die Entropie der wertdiskreten Zufallsgröße $Z_{Y,\hspace{0.05cm}M=4}$ <u>mit der angegebenen Näherung</u>. |

|type="{}"} | |type="{}"} | ||

$H(Z_{Y,\hspace{0.05cm}M=4})\ = \ $ { 2 3% } $\ \rm bit$ | $H(Z_{Y,\hspace{0.05cm}M=4})\ = \ $ { 2 3% } $\ \rm bit$ | ||

| − | {Berechnen Sie die Entropie der wertdiskreten Zufallsgröße $Z_{Y,\hspace{0.05cm}M=8}$ mit der angegebenen Näherung. | + | {Berechnen Sie die Entropie der wertdiskreten Zufallsgröße $Z_{Y,\hspace{0.05cm}M=8}$ <u>mit der angegebenen Näherung</u>. |

|type="{}"} | |type="{}"} | ||

$H(Z_{Y,\hspace{0.05cm}M=8})\ = \ $ { 3 3% } $\ \rm bit$ | $H(Z_{Y,\hspace{0.05cm}M=8})\ = \ $ { 3 3% } $\ \rm bit$ | ||

| Line 59: | Line 65: | ||

{Welche der folgenden Aussagen sind zutreffend? | {Welche der folgenden Aussagen sind zutreffend? | ||

|type="[]"} | |type="[]"} | ||

| − | + Die Entropie einer | + | + Die Entropie einer wertdiskreten Zufallsgröße $Z$ ist stets $H(Z) \ge 0$. |

| − | - Die differenzielle Entropie einer | + | - Die differenzielle Entropie einer wertkontinuierlichen Zufallsgröße $X$ ist stets $h(X) \ge 0$. |

Revision as of 16:01, 16 October 2018

Wir betrachten die zwei wertkontinuierlichen Zufallsgrößen $X$ und $Y$ mit den Wahrscheinlichkeitsdichtefunktionen $f_X(x)$ und $f_Y(y)$. Für diese Zufallsgrößen kann man

- die herkömmlichen Entropien $H(X)$ bzw. $H(Y)$ nicht angeben,

- jedoch aber die differentiellen Entropien $h(X)$ und $h(Y)$.

Wir betrachten außerdem zwei wertdiskrete Zufallsgrößen:

- Die Zufallsgröße $Z_{X,\hspace{0.05cm}M}$ ergibt sich durch (geeignete) Quantisierung der Zufallsgröße $X$ mit der Quantisierungsstufenzahl $N$ ⇒ Quantisierungsintervallbreite ${\it \Delta} = 0.5/M$.

- Die Zufallsgröße $Z_{Y,\hspace{0.05cm}M}$ ergibt sich nach Quantisierung der Zufallsgröße $Y$ mit der Quantisierungsstufenzahl $M$ ⇒ Quantisierungsintervallbreite ${\it \Delta} = 2/M$.

Die Wahrscheinlichkeitsdichtefunktionen dieser diskreten Zufallsgrößen setzen sich jeweils aus $M$ Diracfunktionen zusammen, deren Impulsgewichte durch die Intervallflächen der zugehörigen wertkontinuierlichen Zufallsgrößen gegeben sind.

Daraus lassen sich die Entropien $H(Z_{X,\hspace{0.05cm}M})$ und $H(Z_{Y,\hspace{0.05cm}M})$ in herkömmlicher Weise entsprechend dem Kapitel Wahrscheinlichkeitsfunktion und Entropie bestimmen.

Im Abschnitt Entropie wertkontinuierlicher Zufallsgrößen nach Quantisierung wurde auch eine Näherung angegeben. Beispielsweise gilt:

- $$H(Z_{X, \hspace{0.05cm}M}) \approx -{\rm log}_2 \hspace{0.1cm} ({\it \Delta}) + h(X)\hspace{0.05cm}. $$

- Sie werden im Laufe der Aufgabe feststellen, dass bei rechteckförmiger WDF ⇒ Gleichverteilung diese „Näherung” genau das gleiche Ergebnis liefert wie die direkte Berechnung.

- Aber im allgemeinen Fall – so im Beispiel 2 mit dreieckförmiger WDF – stellt obige Gleichung tatsächlich nur eine Näherung dar, die erst im Grenzfall ${\it \Delta} \to 0$ mit der tatsächlichen Entropie $H(Z_{X,\hspace{0.05cm}M})$ übereinstimmt.

Hinweise:

- Die Aufgabe gehört zum Kapitel Differentielle Entropie.

- Nützliche Hinweise zur Lösung dieser Aufgabe finden Sie insbesondere auf der Seite Entropie wertkontinuierlicher Zufallsgrößen nach Quantisierung .

Fragebogen

Musterlösung

- $$h(X) = {\rm log}_2 \hspace{0.1cm} (x_{\rm max} - x_{\rm min}) = {\rm log}_2 \hspace{0.1cm} (1/2) \hspace{0.15cm}\underline{= - 1\,{\rm bit}}\hspace{0.05cm}.$$

(2) Mit ymin = –1 und ymax = +1 ergibt sich dagegen für die differentielle Entropie der Zufallsgröße Y:

- $$h(Y) = {\rm log}_2 \hspace{0.1cm} (x_{\rm max} - x_{\rm min}) = {\rm log}_2 \hspace{0.1cm} (2) \hspace{0.15cm}\underline{= + 1\,{\rm bit}}\hspace{0.05cm}. $$

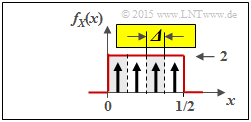

(3) Die nebenstehende Grafik verdeutlicht die bestmögliche Quantisierung der Zufallsgröße X mit der Quantisierungsstufenzahl M = 4 ⇒ Zufallsgröße ZX,\hspace{0.05cm} M = 4:

- Die Intervallbreite ist hier gleich Δ = 0.5/4 = 1/8.

- Die möglichen Werte (jeweils in der Intervallmitte) sind z ∈ {0.0625, 0.1875, 0.3125, 0.4375}.

- Die direkte Entropieberechnung ergibt mit der Wahrscheinlichkeitsfunktion PZ(Z) = [1/4, ... , 1/4]:

- $$H(Z_{X, M = 4}) = {\rm log}_2 \hspace{0.1cm} (4) \hspace{0.15cm}\underline{= 2\,{\rm bit}} \hspace{0.05cm}.$$

(4) Mit der Näherung erhält man unter Berücksichtigung des Ergebnisses der Teilaufgabe (1):

- $$H(Z_{X,\hspace{0.05cm} M = 4}) \approx -{\rm log}_2 \hspace{0.1cm} ({\it \Delta}) + h(X) = 3\,{\rm bit} +(- 1\,{\rm bit})\hspace{0.15cm}\underline{= 2\,{\rm bit}}\hspace{0.05cm}. $$

Hinweis: Nur bei der Gleichverteilung liefert die Näherung genau das gleiche Ergebnis wie die direkte Berechnung, also die tatsächliche Entropie.

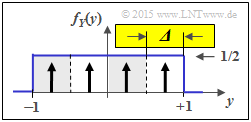

(5) Aus der zweiten Grafik erkennt man die Gemeinsamkeiten / Unterschiede zur Teilaufgabe (3):

- Der Quantisierungsparameter ist nun Δ = 2/4 = 1/2.

- Die möglichen Werte sind nun z ∈ {±0.75, ±0.25}.

- Somit liefert hier die „Näherung” (ebenso wie die direkte Berechnung) das Ergebnis:

- $$H(Z_{Y,\hspace{0.05cm} M = 4}) \approx -{\rm log}_2 \hspace{0.1cm} ({\it \Delta}) + h(Y) = 1\,{\rm bit} + 1\,{\rm bit}\hspace{0.15cm}\underline{= 2\,{\rm bit}}\hspace{0.05cm}.$$

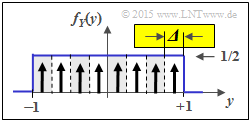

(6) Im Gegensatz zur Teilaufgabe (5) gilt nun Δ = 1/4. Daraus folgt für die „Näherung”:

- $$H(Z_{Y,\hspace{0.05cm} M = 8}) \approx -{\rm log}_2 \hspace{0.1cm} ({\it \Delta}) + h(Y) = 2\,{\rm bit} + 1\,{\rm bit}\hspace{0.15cm}\underline{= 3\,{\rm bit}}\hspace{0.05cm}.$$

Wieder gleiches Ergebnis bei direkter Berechnung.

(7) Richtig ist nur die Aussage 1:

- Die Entropie H(Z) einer diskreten Zufallsgröße Z = {z1, ... , zM} kann nie negativ werden. Der Grenzfall H(Z) = 0 ergibt sich zum Beispiel für Pr(Z = z1) = 1 und Pr(Z = zμ) = 0 für 2 ≤ μ ≤ M.

- Dagegen kann die differentielle Entropie h(X) einer kontinuierlichen Zufallsgröße X negativ (Teilaufgabe 1), positiv (Teilaufgabe 2) oder auch h(X) = 0 ( zum Beispiel xmin = 0, xmax = 1) sein.