Difference between revisions of "Aufgaben:Exercise 3.2Z: Two-dimensional Probability Mass Function"

| Line 74: | Line 74: | ||

:$$P_X(X = 1)= 0+0+1/8 = 1/8 \hspace{0.15cm}\underline{= 0.125},$$ | :$$P_X(X = 1)= 0+0+1/8 = 1/8 \hspace{0.15cm}\underline{= 0.125},$$ | ||

:$$P_X(X = 2) = 0+0+0 \hspace{0.15cm}\underline{= 0}$$ | :$$P_X(X = 2) = 0+0+0 \hspace{0.15cm}\underline{= 0}$$ | ||

| − | :$$P_X(X = 3) = 1/4+1/8+0=3/8 \hspace{0.15cm}\underline{= 0.375}\hspace{0.5cm} \Rightarrow \hspace{0.5cm} P_X(X) = [ 1/2, 1/8 , 0 , 3/8 ].$$ | + | :$$P_X(X = 3) = 1/4+1/8+0=3/8 \hspace{0.15cm}\underline{= 0.375}\hspace{0.5cm} \Rightarrow \hspace{0.5cm} P_X(X) = \big [ 1/2, \ 1/8 , \ 0 , \ 3/8 \big ].$$ |

| − | '''(2)''' Analog zur Teilaufgabe (1) gilt nun: | + | |

| + | '''(2)''' Analog zur Teilaufgabe '''(1)''' gilt nun: | ||

:$$P_Y(Y = y_{\kappa}) = \sum_{x \hspace{0.05cm} \in \hspace{0.05cm} X} \hspace{0.1cm} P_{XY}(x, y_{\kappa})$$ | :$$P_Y(Y = y_{\kappa}) = \sum_{x \hspace{0.05cm} \in \hspace{0.05cm} X} \hspace{0.1cm} P_{XY}(x, y_{\kappa})$$ | ||

| − | :$$P_Y(Y= 0) = 1/4+0+0+1/4 = 1/2 | + | :$$P_Y(Y= 0) = 1/4+0+0+1/4 = 1/2 \hspace{0.15cm}\underline{= 0.500},$$ |

| − | :$$P_Y(Y = 2) = 1/8+1/8+0+0 = 1/4 \hspace{0.15cm}\underline{= 0.250} \hspace{0.5cm} \Rightarrow \hspace{0.5cm} P_Y(Y= 0) = [ 1/2, 1/4 , 1/4 ].$$ | + | :$$P_Y(Y = 1) = 1/8+0+0+1/8 = 1/4 \hspace{0.15cm}\underline{= 0.250},$$ |

| + | :$$P_Y(Y = 2) = 1/8+1/8+0+0 = 1/4 \hspace{0.15cm}\underline{= 0.250} \hspace{0.5cm} \Rightarrow \hspace{0.5cm} P_Y(Y= 0) = \big [ 1/2, \ 1/4 , \ 1/4 ].$$ | ||

| + | |||

| + | |||

| + | '''(3)''' Bei Unabhängigkeit sollte $P_{XY}(X,Y)= P_X(X) \cdot P_Y(Y)$ sein. Dies trifft hier nicht zu: Antwort <u>'''Nein'''</u>. | ||

| − | |||

| − | |||

'''(4)''' Ausgehend von der linken Tabelle ⇒ $P_{XY}(X,Y)$ kommt man zur mittlere Tabelle ⇒ $P_{UY}(U,Y)$, indem man gewisse Wahrscheinlichkeiten entsprechend $U = X \hspace{0.1cm}\text{mod} \hspace{0.1cm} 2$ zusammenfasst. | '''(4)''' Ausgehend von der linken Tabelle ⇒ $P_{XY}(X,Y)$ kommt man zur mittlere Tabelle ⇒ $P_{UY}(U,Y)$, indem man gewisse Wahrscheinlichkeiten entsprechend $U = X \hspace{0.1cm}\text{mod} \hspace{0.1cm} 2$ zusammenfasst. | ||

| + | |||

| + | [[File:P_ID2753__Inf_Z_3_2d_neu.png|center|frame|Verschiedene Wahrscheinlichkeitsfunktionen]] | ||

Berücksichtigt man noch $V = Y \hspace{0.1cm}\text{mod} \hspace{0.1cm} 2$, so erhält man die gesuchten Wahrscheinlichkeiten entsprechend der rechten Tabelle: | Berücksichtigt man noch $V = Y \hspace{0.1cm}\text{mod} \hspace{0.1cm} 2$, so erhält man die gesuchten Wahrscheinlichkeiten entsprechend der rechten Tabelle: | ||

| − | :$$P_{UV}( U = 0, V = 0) = 3/8 \hspace{0.15cm}\underline{= 0.375}, | + | :$$P_{UV}( U = 0, V = 0) = 3/8 \hspace{0.15cm}\underline{= 0.375},\hspace{0.5cm} |

| − | + | P_{UV}( U = 0, V = 1) = 3/8 \hspace{0.15cm}\underline{= 0.375},\hspace{0.5cm}$$ | |

| − | P_{UV}( U = 1, V = 0) = 1/8 \hspace{0.15cm}\underline{= 0.125},\hspace{0.5cm} | + | :$$P_{UV}( U = 1, V = 0) = 1/8 \hspace{0.15cm}\underline{= 0.125},\hspace{0.5cm} |

P_{UV}( U = 1, V = 1) = 1/8 \hspace{0.15cm}\underline{= 0.125}.$$ | P_{UV}( U = 1, V = 1) = 1/8 \hspace{0.15cm}\underline{= 0.125}.$$ | ||

| − | '''(5)''' Die zugehörigen 1D–Wahrscheinlichkeitsfunktionen lauten: $P_U(U) = [1/2 , 1/2 ]$ bzw. $P_V(V)=[3/4, 1/4]$. | + | |

| − | + | '''(5)''' Richtig ist die Antwort <u>'''Ja'''</u>: | |

| + | *Die zugehörigen 1D–Wahrscheinlichkeitsfunktionen lauten: $P_U(U) = \big [1/2 , \ 1/2 \big ]$ bzw. $P_V(V)=\big [3/4, \ 1/4 \big ]$. | ||

| + | *Damit gilt $P_{UV}(U,V) = P_U(U) \cdot P_V(V)$ ⇒ $U$ und $V$ sind statistisch unabhängig. | ||

| + | |||

| + | |||

Revision as of 15:25, 8 October 2018

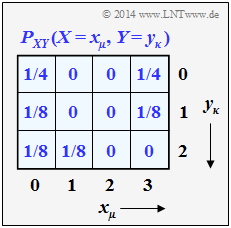

Wir betrachten die Zufallsgrößen $X = \{ 0, 1, 2, 3 \}$ und $Y = \{ 0, 1, 2 \}$, deren gemeinsame Wahrscheinlichkeitsfunktion $P_{XY}(X,Y)$ gegeben ist.

- Aus dieser 2D–Wahrscheinlichkeitsfunktion sollen die eindimensionalen Wahrscheinlichkeitsfunktionen $P_X(X)$ und $P_Y(Y)$ ermittelt werden.

- Man nennt eine solche 1D–Wahrscheinlichkeitsfunktion manchmal auch Randwahrscheinlichkeit (englisch: Marginal Probability).

Gilt $P_{XY}(X, Y) = P_X(X) \cdot P_Y(Y)$, so sind die beiden Zufallsgrößen $X$ und $Y$ statistisch unabhängig. Andernfalls bestehen statistische Bindungen zwischen $X$ und $Y$.

Im zweiten Teil der Aufgabe betrachten wir die Zufallsgrößen $U= \big \{ 0, 1 \big \}$ und $V= \big \{ 0, 1 \big \}$, die sich aus $X$ und $Y$ durch Modulo–2–Operationen ergeben:

- $$U = X \hspace{0.1cm}\text{mod} \hspace{0.1cm} 2, \hspace{0.3cm} V = Y \hspace{0.1cm}\text{mod} \hspace{0.1cm} 2.$$

Hinweise:

- Die Aufgabe gehört zum Kapitel Einige Vorbemerkungen zu den 2D-Zufallsgrößen.

- Ausgegangen wird hier von der gleichen Konstellation wie in [3.2].

- Dort wurde die Zufallsgrößen $Y = \{ 0, 1, 2, 3 \}$ betrachtet, allerdings mit dem Zusatz ${\rm Pr}(Y = 3) = 0$.

- Die so erzwungene Eigenschaft $|X| = |Y|$ war in der vorherigen Aufgabe zur formalen Berechnung des Erwartungswertes ${\rm E}[P_X(X)]$ von Vorteil.

Fragebogen

Musterlösung

- $$P_X(X = x_{\mu}) = \sum_{y \hspace{0.05cm} \in \hspace{0.05cm} Y} \hspace{0.1cm} P_{XY}(x_{\mu}, y).$$

Man erhält folgende Zahlenwerte:

- $$P_X(X = 0) = 1/4+1/8+1/8 = 1/2 \hspace{0.15cm}\underline{= 0.500},$$

- $$P_X(X = 1)= 0+0+1/8 = 1/8 \hspace{0.15cm}\underline{= 0.125},$$

- $$P_X(X = 2) = 0+0+0 \hspace{0.15cm}\underline{= 0}$$

- $$P_X(X = 3) = 1/4+1/8+0=3/8 \hspace{0.15cm}\underline{= 0.375}\hspace{0.5cm} \Rightarrow \hspace{0.5cm} P_X(X) = \big [ 1/2, \ 1/8 , \ 0 , \ 3/8 \big ].$$

(2) Analog zur Teilaufgabe (1) gilt nun:

- $$P_Y(Y = y_{\kappa}) = \sum_{x \hspace{0.05cm} \in \hspace{0.05cm} X} \hspace{0.1cm} P_{XY}(x, y_{\kappa})$$

- $$P_Y(Y= 0) = 1/4+0+0+1/4 = 1/2 \hspace{0.15cm}\underline{= 0.500},$$

- $$P_Y(Y = 1) = 1/8+0+0+1/8 = 1/4 \hspace{0.15cm}\underline{= 0.250},$$

- $$P_Y(Y = 2) = 1/8+1/8+0+0 = 1/4 \hspace{0.15cm}\underline{= 0.250} \hspace{0.5cm} \Rightarrow \hspace{0.5cm} P_Y(Y= 0) = \big [ 1/2, \ 1/4 , \ 1/4 ].$$

(3) Bei Unabhängigkeit sollte $P_{XY}(X,Y)= P_X(X) \cdot P_Y(Y)$ sein. Dies trifft hier nicht zu: Antwort Nein.

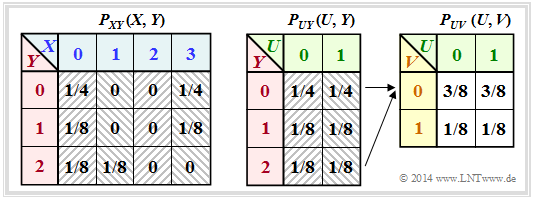

(4) Ausgehend von der linken Tabelle ⇒ $P_{XY}(X,Y)$ kommt man zur mittlere Tabelle ⇒ $P_{UY}(U,Y)$, indem man gewisse Wahrscheinlichkeiten entsprechend $U = X \hspace{0.1cm}\text{mod} \hspace{0.1cm} 2$ zusammenfasst.

Berücksichtigt man noch $V = Y \hspace{0.1cm}\text{mod} \hspace{0.1cm} 2$, so erhält man die gesuchten Wahrscheinlichkeiten entsprechend der rechten Tabelle:

- $$P_{UV}( U = 0, V = 0) = 3/8 \hspace{0.15cm}\underline{= 0.375},\hspace{0.5cm} P_{UV}( U = 0, V = 1) = 3/8 \hspace{0.15cm}\underline{= 0.375},\hspace{0.5cm}$$

- $$P_{UV}( U = 1, V = 0) = 1/8 \hspace{0.15cm}\underline{= 0.125},\hspace{0.5cm} P_{UV}( U = 1, V = 1) = 1/8 \hspace{0.15cm}\underline{= 0.125}.$$

(5) Richtig ist die Antwort Ja:

- Die zugehörigen 1D–Wahrscheinlichkeitsfunktionen lauten: $P_U(U) = \big [1/2 , \ 1/2 \big ]$ bzw. $P_V(V)=\big [3/4, \ 1/4 \big ]$.

- Damit gilt $P_{UV}(U,V) = P_U(U) \cdot P_V(V)$ ⇒ $U$ und $V$ sind statistisch unabhängig.