Difference between revisions of "Aufgaben:Exercise 3.10: Mutual Information at the BSC"

| Line 2: | Line 2: | ||

}} | }} | ||

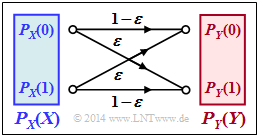

| − | [[File:P_ID2787__Inf_A_3_9.png|right|]] | + | [[File:P_ID2787__Inf_A_3_9.png|right|Betrachtetes BSC–Modell]] |

| − | Wir betrachten den | + | Wir betrachten den [[Kanalcodierung/Kanalmodelle_und_Entscheiderstrukturen#Binary_Symmetric_Channel_.E2.80.93_BSC|Binary Symmetric Channel]] (BSC). Für die gesamte Aufgabe gelten die Parameterwerte: |

| − | + | * Verfälschungswahrscheinlichkeit: $\epsilon = 0.1$ | |

| − | + | * Wahrscheinlichkeit für $0$: $p_0 = 0.2$, | |

| − | + | * Wahrscheinlichkeit für $1$: $p_1 = 0.8$. | |

| − | Damit lautet die Wahrscheinlichkeitsfunktion der Quelle: | + | Damit lautet die Wahrscheinlichkeitsfunktion der Quelle: $P_X(X)= (0.2 , 0.8)$ und für die Quellenentropie gilt: |

| − | + | :$$H(X) = p_0 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{p_0} + p_1\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{p_1} = H_{\rm bin}(0.2)={ 0.7219\,{\rm bit}} \hspace{0.05cm}.$$ | |

| − | $P_X(X)= (0.2 , 0.8)$ | ||

| − | |||

| − | und für die Quellenentropie gilt: | ||

| − | |||

| − | $H(X) = p_0 \cdot | ||

In der Aufgabe sollen ermittelt werden: | In der Aufgabe sollen ermittelt werden: | ||

| − | + | * die Wahrscheinlichkeitsfunktion der Sinke: | |

| − | + | :$$P_Y(Y) = (\hspace{0.05cm}P_Y(0)\hspace{0.05cm}, \hspace{0.05cm} P_Y(1)\hspace{0.05cm}) | |

| − | $P_Y(Y) = (P_Y(0) , P_Y(1))$ | + | \hspace{0.05cm},$$ |

| − | + | * die Verbundwahrscheinlichkeitsfunktion: | |

| − | $P_{XY}(X, Y) = \begin{pmatrix} p_{00} & p_{01}\\ p_{10} & p_{11} \end{pmatrix} \hspace{0.05cm}$ | + | :$P_{XY}(X, Y) = \begin{pmatrix} |

| − | + | p_{00} & p_{01}\\ | |

| − | + | p_{10} & p_{11} | |

| − | $I(X;Y) = E[ | + | \end{pmatrix} \hspace{0.05cm},$ |

| − | + | * die Transinformation: | |

| − | + | :$$I(X;Y) = {\rm E} \hspace{-0.08cm}\left [ \hspace{0.02cm}{\rm log}_2 \hspace{0.1cm} \frac{P_{XY}(X, Y)} | |

| − | $H(X \mid Y) = E[ | + | {P_{X}(X) \cdot P_{Y}(Y) }\right ] \hspace{0.05cm},$$ |

| − | + | *die Äquivokation: | |

| + | :$$H(X \hspace{-0.1cm}\mid \hspace{-0.1cm} Y) = {\rm E} \hspace{0.02cm} \big [ \hspace{0.02cm} {\rm log}_2 \hspace{0.1cm} \frac{1}{P_{\hspace{0.03cm}X \mid \hspace{0.03cm} Y} (X \hspace{-0.05cm}\mid \hspace{-0.05cm} Y)} \big ] \hspace{0.05cm},$$ | ||

| + | *die Irrelevanz: | ||

| + | :$$H(Y \hspace{-0.1cm}\mid \hspace{-0.1cm} X) = {\rm E} \hspace{0.02cm} \big [ \hspace{0.02cm} {\rm log}_2 \hspace{0.1cm} \frac{1}{P_{\hspace{0.03cm}Y \mid \hspace{0.03cm} X} (Y \hspace{-0.05cm}\mid \hspace{-0.05cm} X)} \big ] \hspace{0.05cm}.$$ | ||

| − | |||

| − | '' | + | ''Hinweise:'' |

| + | *Die Aufgabe gehört zum Kapitel [[Informationstheorie/Anwendung_auf_die_Digitalsignalübertragung|Anwendung auf die Digitalsignalübertragung]]. | ||

| + | *Bezug genommen wird insbesondere auf die Seite [[Informationstheorie/Anwendung_auf_die_Digitalsignalübertragung#Transinformationsberechnung_f.C3.BCr_den_Bin.C3.A4rkanal|Transinformationsberechnung für den Binärkanal]]. | ||

| + | *In der [[Aufgaben:3.10Z_BSC–Kanalkapazität|Zusatzaufgabe 3.9Z] wird die Kanalkapazität] $C_{\rm BSC }$ des BSC–Modells berechnet. | ||

| + | *Diese ergibt sich als die maximale Transinformation $I(X; Y)$ durch Maximierung bezüglich der Symbolwahrscheinlichkeiten $p_0$ bzw. $p_1 = 1 – p_0$. | ||

| + | *Sollte die Eingabe des Zahlenwertes „0” erforderlich sein, so geben Sie bitte „0.” ein. | ||

Revision as of 09:27, 7 June 2017

Wir betrachten den Binary Symmetric Channel (BSC). Für die gesamte Aufgabe gelten die Parameterwerte:

- Verfälschungswahrscheinlichkeit: $\epsilon = 0.1$

- Wahrscheinlichkeit für $0$: $p_0 = 0.2$,

- Wahrscheinlichkeit für $1$: $p_1 = 0.8$.

Damit lautet die Wahrscheinlichkeitsfunktion der Quelle: $P_X(X)= (0.2 , 0.8)$ und für die Quellenentropie gilt:

- $$H(X) = p_0 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{p_0} + p_1\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{p_1} = H_{\rm bin}(0.2)={ 0.7219\,{\rm bit}} \hspace{0.05cm}.$$

In der Aufgabe sollen ermittelt werden:

- die Wahrscheinlichkeitsfunktion der Sinke:

- $$P_Y(Y) = (\hspace{0.05cm}P_Y(0)\hspace{0.05cm}, \hspace{0.05cm} P_Y(1)\hspace{0.05cm}) \hspace{0.05cm},$$

- die Verbundwahrscheinlichkeitsfunktion:

- $P_{XY}(X, Y) = \begin{pmatrix} p_{00} & p_{01}\\ p_{10} & p_{11} \end{pmatrix} \hspace{0.05cm},$ * die Transinformation: :'"`UNIQ-MathJax23-QINU`"' *die Äquivokation: :'"`UNIQ-MathJax24-QINU`"' *die Irrelevanz: :'"`UNIQ-MathJax25-QINU`"' ''Hinweise:'' *Die Aufgabe gehört zum Kapitel [[Informationstheorie/Anwendung_auf_die_Digitalsignalübertragung|Anwendung auf die Digitalsignalübertragung]]. *Bezug genommen wird insbesondere auf die Seite [[Informationstheorie/Anwendung_auf_die_Digitalsignalübertragung#Transinformationsberechnung_f.C3.BCr_den_Bin.C3.A4rkanal|Transinformationsberechnung für den Binärkanal]]. *In der [[Aufgaben:3.10Z_BSC–Kanalkapazität|Zusatzaufgabe 3.9Z] wird die Kanalkapazität] $C_{\rm BSC }$ des BSC–Modells berechnet. *Diese ergibt sich als die maximale Transinformation $I(X; Y)$ durch Maximierung bezüglich der Symbolwahrscheinlichkeiten $p_0$ bzw. $p_1 = 1 – p_0$. *Sollte die Eingabe des Zahlenwertes „0” erforderlich sein, so geben Sie bitte „0.” ein. ==='"`UNIQ--h-0--QINU`"'Fragebogen=== '"`UNIQ--quiz-00000002-QINU`"' ==='"`UNIQ--h-1--QINU`"'Musterlösung=== '"`UNIQ--html-00000003-QINU`"' '''1.''' Für die gesuchten Größen gilt allgemein bzw. mit den Zahlenwerten $p_0 = 0.2$ und $ε = 0.1$: $P_{ XY }(0 , 0) = p_0 . (1 - \varepsilon ) = 0.18 $ , $P_{XY}(0,1) = p_0 . \varepsilon = 0.02$, $P_{XY}(1,0) = p_1 . \varepsilon = 0.08$ , $P_{ XY }(1 , 1) = p_1 . (1 - \varepsilon ) = 0.72$. '''2.''' Es gilt: '"`UNIQ-MathJax26-QINU`"' '"`UNIQ-MathJax27-QINU`"' '''3.''' Für die Transinformation gilt gemäß der Definition mit $p_0 = 0.2$ , $p_1 = 0.8$ und $ε = 0.1$ '"`UNIQ-MathJax28-QINU`"' '"`UNIQ-MathJax29-QINU`"' '''4.''' Mit der angegebenen Quellenentropie $H(X)$ erhält man für die Äquivokation: '"`UNIQ-MathJax30-QINU`"'. Man könnte auch die allgemeine Definition mit den Rückschlusswahrscheinlichkeiten $P_{X|Y}(⋅)$ anwenden: '"`UNIQ-MathJax31-QINU`"' Im Beispiel erhält man auch nach dieser Berechnungsvorschrift das gleiche Ergebnis $H(X|Y) = 0.3642 bit$ : '"`UNIQ-MathJax32-QINU`"' '''5.''' Richtig ist der ''Lösungsvorschlag 2.'' Bei gestörter Übertragung $(ε > 0)$ ist die Unsicherheit hinsichtlich der Sinke stets größer als die Unsicherheit bezüglich der Quelle. Man erhält hier als Zahlenwert: '"`UNIQ-MathJax33-QINU`"' Bei fehlerfreier Übertragung $(ε = 0)$ würde dagegen $P_Y(⋅) = P_X(⋅)$ und $H(Y) = H(X)$ gelten '''6.''' Auch hier ist der ''zweite Lösungsvorschlag'' richtig. Wegen '"`UNIQ-MathJax34-QINU`"' ist $H(Y|X)$ um den gleichen Betrag größer als $H(X|Y)$, um den auch $H(Y)$ größer ist als $H(X)$: '"`UNIQ-MathJax35-QINU`"' Bei direkter Berechnung erhält man das gleiche Ergebnis $H(Y|X) = 0.4690 bit$:

$$H(Y \hspace{-0.1cm}\mid \hspace{-0.1cm} X) \hspace{-0.15cm} = \hspace{-0.15cm} {\rm E} \hspace{0.02cm} \big [ \hspace{0.02cm} {\rm log}_2 \hspace{0.1cm} \frac{1}{P_{\hspace{0.03cm}Y \mid \hspace{0.03cm} X} (Y \hspace{-0.05cm}\mid \hspace{-0.05cm} X)} \big ] =$$ $$=\hspace{-0.15cm} 0.18 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.9} + 0.02 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.1} + 0.08 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.1} + 0.72 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.9} \hspace{0.05cm}$$