Difference between revisions of "Aufgaben:Exercise 3.14: Channel Coding Theorem"

| Line 73: | Line 73: | ||

{{ML-Kopf}} | {{ML-Kopf}} | ||

'''(1)''' Richtig ist der <u>Lösungsvorschlag 3</u>: | '''(1)''' Richtig ist der <u>Lösungsvorschlag 3</u>: | ||

| − | *Die BSC–Fehlerwahrscheinlichkeit ist mit $p_0 = p_1 = 0.5$ bei uncodierter Übertragung ⇒ nbsp; $R = 1$: | + | *Die BSC–Fehlerwahrscheinlichkeit ist mit $p_0 = p_1 = 0.5$ bei uncodierter Übertragung ⇒ $R = 1$: |

:$$ p_{\rm B} = 0.5 \cdot 0.25 + 0.5 \cdot 0.25=0.25 \hspace{0.05cm}.$$ | :$$ p_{\rm B} = 0.5 \cdot 0.25 + 0.5 \cdot 0.25=0.25 \hspace{0.05cm}.$$ | ||

Entsprechend gilt bei gleichen Randbedingungen für das EUC–Modell: | Entsprechend gilt bei gleichen Randbedingungen für das EUC–Modell: | ||

| Line 80: | Line 80: | ||

'''(2)''' Richtig ist der <u>Lösungsvorschlag 3</u>: | '''(2)''' Richtig ist der <u>Lösungsvorschlag 3</u>: | ||

| − | *Beim BSC–Modell mit der Verfälschungswahrscheinlichkeit $ε = 0.25$ gilt bei uncodierter Übertragung ⇒ nbsp; $R = 1$ unabhängig von $p_0$ und $p_1$ für die Bitfehlerwahrscheinlichkeit: $p_B = 0.25$. Dagegen erhält man beim EUC–Modell beispielsweise mit $p_0 = 0.6$ und $p_1 = 0.4$ eine kleinere Bitfehlerwahrscheinlichkeit: | + | *Beim BSC–Modell mit der Verfälschungswahrscheinlichkeit $ε = 0.25$ gilt bei uncodierter Übertragung ⇒ $R = 1$ unabhängig von $p_0$ und $p_1$ für die Bitfehlerwahrscheinlichkeit: $p_B = 0.25$. |

| + | *Dagegen erhält man beim EUC–Modell beispielsweise mit $p_0 = 0.6$ und $p_1 = 0.4$ eine kleinere Bitfehlerwahrscheinlichkeit: | ||

:$$p_{\rm B} = 0.6 \cdot 0 + 0.4 \cdot 0.5=0.2 \hspace{0.05cm}.$$ | :$$p_{\rm B} = 0.6 \cdot 0 + 0.4 \cdot 0.5=0.2 \hspace{0.05cm}.$$ | ||

*Zu beachten ist jedoch, dass nun die Quellenentropie nicht mehr $H(X) = 1\ \rm (bit)$ beträgt, sondern nur mehr $H(X) = H_{bin} (0.6) = 0.971 \ \rm (bit)$. | *Zu beachten ist jedoch, dass nun die Quellenentropie nicht mehr $H(X) = 1\ \rm (bit)$ beträgt, sondern nur mehr $H(X) = H_{bin} (0.6) = 0.971 \ \rm (bit)$. | ||

| Line 90: | Line 91: | ||

'''(3)''' Richtig ist der <u>Lösungsvorschlag 1</u>: | '''(3)''' Richtig ist der <u>Lösungsvorschlag 1</u>: | ||

*Aus der Grafik auf der Angabenseite lässt sich für die Kapazitäten der beiden Kanäle ablesen: | *Aus der Grafik auf der Angabenseite lässt sich für die Kapazitäten der beiden Kanäle ablesen: | ||

| − | :$$C_{\rm BSC} = 0.1887 \ \rm {bit/use}, \hspace{0.5cm} | + | :$$C_{\rm BSC} = 0.1887 \ \rm {bit/use}, \hspace{0.5cm}C_{rm EUC} = 0.3219 \ \rm {bit/use}.$$ |

| − | *Nach dem Kanalcodierungstheorem kann unter der Bedingung $R ≤ C$ eine Kanalcodierung gefunden werden, mit der die Fehlerwahrscheinlichkeit zu $0$ gemacht werden kann. Bei beiden Kanälen trifft diese Bedingung mit der Rate mit $R = 0.16$ zu. | + | *Nach dem Kanalcodierungstheorem kann unter der Bedingung $R ≤ C$ eine Kanalcodierung gefunden werden, mit der die Fehlerwahrscheinlichkeit zu $0$ gemacht werden kann. |

| + | *Bei beiden Kanälen trifft diese Bedingung mit der Rate mit $R = 0.16$ zu. | ||

'''(4)''' Richtig ist der <u>Lösungsvorschlag 3</u>: | '''(4)''' Richtig ist der <u>Lösungsvorschlag 3</u>: | ||

| − | *Beim EUC–Modell wird mit $R = 0.32$ und $C = 0.3219$ die notwendige Bedingung $R ≤ C$ für eine fehlerfreie Übertragung erfüllt. *Voraussetzung hierfür ist allerdings die Wahrscheinlichkeitsfunktion $P_X(X) = (0.6, 0.4).$ | + | *Beim EUC–Modell wird mit $R = 0.32$ und $C = 0.3219$ die notwendige Bedingung $R ≤ C$ für eine fehlerfreie Übertragung erfüllt. |

| − | *Dagegen ergäbe sich für gleichwahrscheinliche Symbole ⇒ nbsp; $P_X(X) = (0.5, 0.5)$ die Transinformation $I(X; Y) = 0.3113$, also ein kleinerer Wert als für die Kanalkapazität $C$, und es gilt auch $I(X; Y) < R$. | + | *Voraussetzung hierfür ist allerdings die Wahrscheinlichkeitsfunktion $P_X(X) = (0.6, 0.4).$ |

| − | *Man erkennt: Das EUC–Modell bietet mehr Potenzial für die Anwendung einer Kanalcodierung als das BSC–Modell. Hier kann beispielsweise im Code ausgenutzt werden, dass eine gesendete „0” stets fehlerfrei übertragen wird. | + | *Dagegen ergäbe sich für gleichwahrscheinliche Symbole ⇒ $P_X(X) = (0.5,\ 0.5)$ die Transinformation $I(X; Y) = 0.3113$, also ein kleinerer Wert als für die Kanalkapazität $C$, und es gilt auch $I(X; Y) < R$. |

| + | *Man erkennt: Das EUC–Modell bietet mehr Potenzial für die Anwendung einer Kanalcodierung als das BSC–Modell. Hier kann beispielsweise im Code ausgenutzt werden, dass eine gesendete „0” stets fehlerfrei übertragen wird. | ||

| − | '''(5)''' Aus der Kommentierung der Teilaufgaben (3) und (4) geht hervor, dass der <u>Lösungsvorschlag 4</u> zutrifft. | + | '''(5)''' Aus der Kommentierung der Teilaufgaben '''(3)''' und '''(4)''' geht hervor, dass der <u>Lösungsvorschlag 4</u> zutrifft. |

{{ML-Fuß}} | {{ML-Fuß}} | ||

Revision as of 15:17, 12 October 2018

Shannons Kanalcodierungstheorem besagt, dass über einen diskreten gedächtnislosen Kanal (englisch: Discrete Memoryless Channel, DMC) mit der Coderate $R$ fehlerfrei übertragen werden kann, so lange $R$ nicht größer ist als die Kanalkapazität

- $$C = \max_{P_X(X)} \hspace{0.15cm} I(X;Y) \hspace{0.05cm}.$$

Das Kanalcodierungstheorem soll in dieser Aufgabe numerisch ausgewertet werden, wobei zwei typische Kanalmodelle zu betrachten sind:

- das BSC–Modell (Binary Symmetric Channel) mit Verfälschungswahrscheinlichkeit $ε = 0.25$ und der Kanalkapazität $C = 1 - H_{\rm bin}(ε),$

- das so genannte EUC–Modell (von Extremely Unsymmetric Channel, diese Bezeichnung stammt von uns und ist nicht allgemein üblich) entsprechend der Aufgabe 3.11Z.

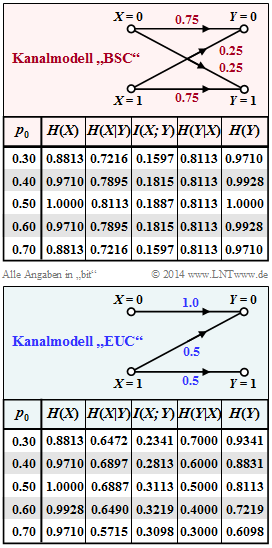

Die Grafiken zeigen die numerischen Werte der informationstheoretischen Größen für die beiden Kanäle „BSC” und „EUC”:

- die Quellenentropie $H(X),$

- die Äquivokation $H(X|Y),$

- die Transinformation $I(X; Y),$

- die Irrelevanz $H(Y|X),$ und

- die Sinkenentropie $H(Y).$

Der Parameter in diesen Tabellen ist $p_0 = {\rm Pr}(X = 0)$ im Bereich zwischen $p_0 = 0.3$ bis $p_0 = 0.7.$ Für die zweite Quellensymbolwahrscheinlichkeit gilt: $p_1 = {\rm Pr}(X = 1) =1 - p_0$.

Hinweise:

- Die Aufgabe gehört zum Kapitel Anwendung auf die Digitalsignalübertragung.

- Bezug genommen wird insbesondere auf die Seite Definition und Bedeutung der Kanalkapazität.

Fragebogen

Musterlösung

- Die BSC–Fehlerwahrscheinlichkeit ist mit $p_0 = p_1 = 0.5$ bei uncodierter Übertragung ⇒ $R = 1$:

- $$ p_{\rm B} = 0.5 \cdot 0.25 + 0.5 \cdot 0.25=0.25 \hspace{0.05cm}.$$

Entsprechend gilt bei gleichen Randbedingungen für das EUC–Modell:

- $$ p_{\rm B} = 0.5 \cdot 0 + 0.5 \cdot 0.5=0.25 \hspace{0.05cm}.$$

(2) Richtig ist der Lösungsvorschlag 3:

- Beim BSC–Modell mit der Verfälschungswahrscheinlichkeit $ε = 0.25$ gilt bei uncodierter Übertragung ⇒ $R = 1$ unabhängig von $p_0$ und $p_1$ für die Bitfehlerwahrscheinlichkeit: $p_B = 0.25$.

- Dagegen erhält man beim EUC–Modell beispielsweise mit $p_0 = 0.6$ und $p_1 = 0.4$ eine kleinere Bitfehlerwahrscheinlichkeit:

- $$p_{\rm B} = 0.6 \cdot 0 + 0.4 \cdot 0.5=0.2 \hspace{0.05cm}.$$

- Zu beachten ist jedoch, dass nun die Quellenentropie nicht mehr $H(X) = 1\ \rm (bit)$ beträgt, sondern nur mehr $H(X) = H_{bin} (0.6) = 0.971 \ \rm (bit)$.

- Im Grenzfall $p_0 = 1$ werden nur noch Nullen übertragen und es gilt $H(X) = 0$. Für die Bitfehlerwahrscheinlichkeit gilt dann aber tatsächlich:

- $$ p_{\rm B} = 1 \cdot 0 + 0 \cdot 0.5=0 \hspace{0.05cm}.$$

- Man überträgt also keinerlei Information, diese aber mit der Bitfehlerwahrscheinlichkeit $0$.

(3) Richtig ist der Lösungsvorschlag 1:

- Aus der Grafik auf der Angabenseite lässt sich für die Kapazitäten der beiden Kanäle ablesen:

- $$C_{\rm BSC} = 0.1887 \ \rm {bit/use}, \hspace{0.5cm}C_{rm EUC} = 0.3219 \ \rm {bit/use}.$$

- Nach dem Kanalcodierungstheorem kann unter der Bedingung $R ≤ C$ eine Kanalcodierung gefunden werden, mit der die Fehlerwahrscheinlichkeit zu $0$ gemacht werden kann.

- Bei beiden Kanälen trifft diese Bedingung mit der Rate mit $R = 0.16$ zu.

(4) Richtig ist der Lösungsvorschlag 3:

- Beim EUC–Modell wird mit $R = 0.32$ und $C = 0.3219$ die notwendige Bedingung $R ≤ C$ für eine fehlerfreie Übertragung erfüllt.

- Voraussetzung hierfür ist allerdings die Wahrscheinlichkeitsfunktion $P_X(X) = (0.6, 0.4).$

- Dagegen ergäbe sich für gleichwahrscheinliche Symbole ⇒ $P_X(X) = (0.5,\ 0.5)$ die Transinformation $I(X; Y) = 0.3113$, also ein kleinerer Wert als für die Kanalkapazität $C$, und es gilt auch $I(X; Y) < R$.

- Man erkennt: Das EUC–Modell bietet mehr Potenzial für die Anwendung einer Kanalcodierung als das BSC–Modell. Hier kann beispielsweise im Code ausgenutzt werden, dass eine gesendete „0” stets fehlerfrei übertragen wird.

(5) Aus der Kommentierung der Teilaufgaben (3) und (4) geht hervor, dass der Lösungsvorschlag 4 zutrifft.