Exercise 1.2: Entropy of Ternary Sources

From LNTwww

- Die Entropie einer wertdiskreten gedächtnislosen Nachrichtenquelle mit M möglichen Symbolen lautet:

- $$H = \sum_{\mu = 1}^M p_{\mu} \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{p_\mu}\hspace{0.05cm},\hspace{0.3cm} {\rm Pseudoeinheit\hspace{-0.15cm}: \hspace{0.15cm}bit}\hspace{0.05cm}.$$

- Hierbei bezeichnen die pμ die Auftrittswahrscheinlichkeiten der einzelnen Symbole bzw. Ereignisse. Im vorliegenden Beispiel werden die Ereignisse mit R(ot), G(rün) und S(chwarz) bezeichnet.

- Bei einer binären Quelle mit den Auftrittswahrscheinlichkeiten p und 1 – p kann hierfür geschrieben werden:

- $$H = H_{\rm bin}(p) = p \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{p}+ (1-p) \cdot {\rm log}_2\hspace{0.1cm}\frac{1}{1-p}\hspace{0.05cm}.$$

- Die Entropie einer mehrstufigen Quelle lässt sich häufig mit dieser „binären Entropiefunktion” Hbin(p) – ebenfalls mit der Pseudoeinheit „bit” – ausdrücken.

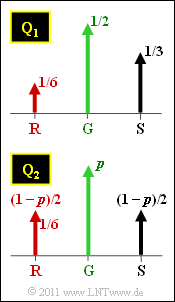

- Betrachtet werden in dieser Aufgabe zwei Ternärquellen mit den Symbolwahrscheinlichkeiten gemäß der obigen Grafik:

- die Quelle Q1 mit pG = 1/2, pS = 1/3, pR = 1/6,

- die Quelle Q2 mit pG = p, pR = pS = (1 – p)/2.

- Die Ternärquelle Q2 lässt sich auch auf Roulette anwenden, wenn ein Spieler nur auf die Felder Rot, Schwarz und Grün (die „Null”) setzt. Dieser Spieltyp wird im Fragebogen mit „Roulette 1” bezeichnet.

- Dagegen weist „Roulette 2” darauf hin, dass der Spieler auf einzelne Zahlen (0, ... , 36) setzt.

- Hinweis: Die Aufgabe bezieht sich auf das Kapitel 1.1.

Fragebogen

Musterlösung

- 2. Mit den Auftrittswahrscheinlichkeiten 1/2, 1/3 und 1/6 erhält man folgenden Entropiewert:

- $$H \hspace{0.1cm} = \hspace{0.1cm} 1/2 \cdot {\rm log}_2\hspace{0.1cm}(2) +1/3 \cdot {\rm log}_2\hspace{0.1cm}(3) +1/6 \cdot {\rm log}_2\hspace{0.1cm}(6) =\\ \hspace{0.1cm} = \hspace{0.1cm} (1/2 + 1/6)\cdot {\rm log}_2\hspace{0.1cm}(2) + (1/3 + 1/6)\cdot {\rm log}_2\hspace{0.1cm}(3) =\\ \hspace{0.1cm} = \hspace{0.1cm} 2/3 \cdot 1\,{\rm bit} + 1/2 \cdot 1.585\,{\rm bit}\hspace{0.15cm}\underline {\approx 1.46 \, {\rm bit}} \hspace{0.05cm}.$$

- 2. Richtig ist Lösungsvorschlag 2. Die Entropie hängt nur von den Auftrittswahrscheinlichkeiten ab. Es ist dabei egal, welche Zahlenwerte oder physikalische Größen man den einzelnen Symbolen zuordnet. Anders ist es bei Mittelwerten oder der AKF–Berechnung. Werden nur Symbole angegeben, so kann man hierfür keine Momente angeben. Außerdem hängen die Mittelwerte, Autokorrelation, usw. davon ab, ob man die Zuordnung bipolar (–1, 0, +1) oder unipolar (zum Beispiel: 0, 1, 2) vereinbart.

- 3. Die Entropie der Quelle Q2 lässt sich wie folgt ausdrücken:

- $$H \hspace{0.1cm} = \hspace{0.1cm} p \cdot {\rm log}_2\hspace{0.1cm}\frac {1}{p}+ 2 \cdot \frac{1-p}{2} \cdot {\rm log}_2\hspace{0.1cm}\frac {2}{1-p}=\\ \hspace{0.1cm} = \hspace{0.1cm} p \cdot {\rm log}_2\hspace{0.1cm}\frac {1}{p}+ (1-p) \cdot {\rm log}_2\hspace{0.1cm}\frac {1}{1-p} + (1-p)\cdot {\rm log}_2\hspace{0.1cm}(2)= H_{\rm bin}(p) + 1-p \hspace{0.05cm}.$$

- Für p = 0.5 ⇒ Hbin(p) = 1 ergibt sich H = 1.5 bit.

- 4. Die maximale Entropie einer gedächtnislosen Quelle mit dem Symbolumfang M ergibt sich, wenn alle M Symbole gleichwahrscheinlich sind. Für den Sonderfall M = 3 folgt daraus:

- $$p_{\rm R} + p_{\rm G} + p_{\rm S} = 1 \hspace{0.3cm} \Rightarrow \hspace{0.3cm} \underline {p = 1/3}\hspace{0.05cm}.$$

- Damit erhält man mit dem Ergebnis der Teilaufgabe (3) die folgende Entropie:

- $$H \hspace{0.1cm} = \hspace{0.1cm} H_{\rm bin}(1/3) + 1-1/3 = 1/3 \cdot {\rm log}_2\hspace{0.1cm}(3) + 2/3 \cdot {\rm log}_2\hspace{0.1cm}(3/2) + 2/3 =\\ \hspace{0.1cm} = \hspace{0.1cm} 1/3 \cdot {\rm log}_2\hspace{0.1cm}(3) + 2/3 \cdot {\rm log}_2\hspace{0.1cm}(3) - 2/3 \cdot {\rm log}_2\hspace{0.1cm}(2)+ 2/3 = {\rm log}_2\hspace{0.1cm}(3) = {1.585 \, {\rm bit}} \hspace{0.05cm}.$$

- 5. „Roulette 1” ist informationstheoretisch gleich der Konfiguration Q2 mit p = 1/37:

- $$p_{\rm G} = p = \frac{1}{37}\hspace{0.05cm},\hspace{0.2cm} p_{\rm R} = p_{\rm S} = \frac{1-p}{2} = \frac{18}{37} \hspace{0.05cm}.$$

- Damit erhält man mit dem Ergebnis der Teilaufgabe (3):

- $$H \hspace{0.1cm} = \hspace{0.1cm} H_{\rm bin}(1/37) + \frac{36}{37} = \frac{1}{37} \cdot {\rm log}_2\hspace{0.1cm}(37) + \frac{36}{37} \cdot {\rm log}_2\hspace{0.1cm}(37) - \frac{36}{37} \cdot {\rm log}_2\hspace{0.1cm}36 + \frac{36}{37} =\\ \hspace{0.1cm} = \hspace{0.1cm} {\rm log}_2\hspace{0.1cm}(37) + \frac{36}{37} \cdot ( 1- {\rm log}_2\hspace{0.1cm}(36)) = 5.209 - 4.057 \hspace{0.15cm} \underline { = 1.152 \, {\rm bit}} \hspace{0.05cm}.$$

- 6. Setzt man bei Roulette auf einzelne Zahlen ⇒ Konfiguration „Roulette 2”, so sind alle Zahlen von 0 bis 36 gleichwahrscheinlich und man erhält:

- $$H = {\rm log}_2\hspace{0.1cm}(37) \hspace{0.15cm} \underline { = 5.209 \, {\rm bit}} \hspace{0.05cm}.$$