Difference between revisions of "Theory of Stochastic Signals/Moments of a Discrete Random Variable"

| Line 6: | Line 6: | ||

}} | }} | ||

==Berechnung als Schar- bzw. Zeitmittelwert== | ==Berechnung als Schar- bzw. Zeitmittelwert== | ||

| + | <br> | ||

Die Wahrscheinlichkeiten bzw. die relativen Häufigkeiten liefern weitreichende Informationen über eine diskrete Zufallsgröße. Reduzierte Informationen erhält man durch die so genannten Momente $m_k$, wobei $k$ eine natürliche Zahl darstellt. | Die Wahrscheinlichkeiten bzw. die relativen Häufigkeiten liefern weitreichende Informationen über eine diskrete Zufallsgröße. Reduzierte Informationen erhält man durch die so genannten Momente $m_k$, wobei $k$ eine natürliche Zahl darstellt. | ||

| + | {{BlaueBox|TEXT= | ||

| + | $\text{Zwei alternative Berechnungsmöglichkeiten:}$ | ||

Unter der hier stillschweigend vorausgesetzten [[Stochastische_Signaltheorie/Autokorrelationsfunktion_(AKF)#Ergodische_Zufallsprozesse|Ergodizität]] gibt es für das Moment $k$-ter Ordnung zwei unterschiedliche Berechnungsmöglichkeiten: | Unter der hier stillschweigend vorausgesetzten [[Stochastische_Signaltheorie/Autokorrelationsfunktion_(AKF)#Ergodische_Zufallsprozesse|Ergodizität]] gibt es für das Moment $k$-ter Ordnung zwei unterschiedliche Berechnungsmöglichkeiten: | ||

*die '''Scharmittelung''' bzw. ''Erwartungswertbildung'' (Mittelung über alle möglichen Werte): | *die '''Scharmittelung''' bzw. ''Erwartungswertbildung'' (Mittelung über alle möglichen Werte): | ||

| − | :$$m_k = {\rm E} [z^k ] = \sum_{\mu = 1}^{M}p_\mu \cdot z_\mu^k \hspace{2cm} \rm mit \hspace{0.1cm} {\rm E[...]\hspace{-0.1cm}:} \hspace{0.1cm} \rm Erwartungswert ,$$ | + | :$$m_k = {\rm E} [z^k ] = \sum_{\mu = 1}^{M}p_\mu \cdot z_\mu^k \hspace{2cm} \rm mit \hspace{0.1cm} {\rm E[\text{ ...} ]\hspace{-0.1cm}:} \hspace{0.1cm} \rm Erwartungswert ,$$ |

| − | *die '''Zeitmittelung''' über die Zufallsfolge $\langle z_ν\rangle$ mit der Laufvariablen $ν = 1 , \ ... \ , N$: | + | *die '''Zeitmittelung''' über die Zufallsfolge $\langle z_ν\rangle$ mit der Laufvariablen $ν = 1 , \hspace{0.1cm}\text{ ...} \hspace{0.1cm} , N$: |

| − | :$$m_k=\overline{z_\nu^k}=\hspace{0.01cm}\lim_{N\to\infty}\frac{1}{N}\sum_{\nu=\rm 1}^{\it N}z_\nu^k\hspace{1.7cm}\rm mit\hspace{0.1cm}\ddot{u}berstreichender\hspace{0.1cm}Linie\hspace{-0.1cm}:\hspace{0.1cm}Zeitmittelwert.$$ | + | :$$m_k=\overline{z_\nu^k}=\hspace{0.01cm}\lim_{N\to\infty}\frac{1}{N}\sum_{\nu=\rm 1}^{\it N}z_\nu^k\hspace{1.7cm}\rm mit\hspace{0.1cm}\ddot{u}berstreichender\hspace{0.1cm}Linie\hspace{-0.1cm}:\hspace{0.1cm}Zeitmittelwert.$$}} |

| + | |||

Anzumerken ist: | Anzumerken ist: | ||

| Line 19: | Line 23: | ||

==Linearer Mittelwert - Gleichanteil== | ==Linearer Mittelwert - Gleichanteil== | ||

| + | <br> | ||

| + | {{BlaueBox|TEXT= | ||

| + | $\text{Definition:}$ | ||

Mit $k = 1$ erhält man aus der allgemeinen Gleichung für die Momente den '''linearen Mittelwert''': | Mit $k = 1$ erhält man aus der allgemeinen Gleichung für die Momente den '''linearen Mittelwert''': | ||

| − | $$m_1 =\sum_{\mu=1}^{M}p_\mu\cdot z_\mu =\lim_{N\to\infty}\frac{1}{N}\sum_{\nu=1}^{N}z_\nu.$$ | + | :$$m_1 =\sum_{\mu=1}^{M}p_\mu\cdot z_\mu =\lim_{N\to\infty}\frac{1}{N}\sum_{\nu=1}^{N}z_\nu.$$ |

| − | Der linke Teil dieser Gleichung beschreibt die Scharmittelung (über alle möglichen Werte), während die rechte Gleichung die Bestimmung als Zeitmittelwert angibt. In Zusammenhang mit Signalen wird diese Größe auch als der | + | Der linke Teil dieser Gleichung beschreibt die Scharmittelung (über alle möglichen Werte), während die rechte Gleichung die Bestimmung als Zeitmittelwert angibt. In Zusammenhang mit Signalen wird diese Größe auch als der [[Signaldarstellung/Gleichsignal_-_Grenzfall_eines_periodischen_Signals|Gleichanteil]] bezeichnet.}} |

| − | + | ||

| − | [[File:P_ID49__Sto_T_2_2_S2_neu.png|right|frame|Gleichanteil eines Binärsignals]] | + | [[File:P_ID49__Sto_T_2_2_S2_neu.png|right|frame|Gleichanteil $m_1$ eines Binärsignals]] |

| − | Ein Binärsignal mit den beiden Amplitudenwerten | + | {{GraueBox|TEXT= |

| + | $\text{Beispiel 1:}$ | ||

| + | Ein Binärsignal $x(t)$ mit den beiden möglichen Amplitudenwerten | ||

*$1\hspace{0.03cm}\rm V$ (für das Symbol $\rm L$), | *$1\hspace{0.03cm}\rm V$ (für das Symbol $\rm L$), | ||

*$3\hspace{0.03cm}\rm V$ (für das Symbol $\rm H$) | *$3\hspace{0.03cm}\rm V$ (für das Symbol $\rm H$) | ||

| + | |||

sowie den Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ bzw. $p_{\rm H} = 0.8$ besitzt den linearen Mittelwert (Gleichanteil ) | sowie den Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ bzw. $p_{\rm H} = 0.8$ besitzt den linearen Mittelwert (Gleichanteil ) | ||

| − | $$m_1 = 0.2 \cdot 1\,{\rm V}+ 0.8 \cdot 3\,{\rm V}= 2.6 \,{\rm V}. $$ | + | :$$m_1 = 0.2 \cdot 1\,{\rm V}+ 0.8 \cdot 3\,{\rm V}= 2.6 \,{\rm V}. $$ |

Dieser ist in der Grafik als rote Linie eingezeichnet. | Dieser ist in der Grafik als rote Linie eingezeichnet. | ||

| − | + | <br clear=all> | |

Bestimmt man diese Kenngröße durch Zeitmittelung über die dargestellten $N = 12$ Signalwerte, so erhält man einen etwas kleineren Wert: | Bestimmt man diese Kenngröße durch Zeitmittelung über die dargestellten $N = 12$ Signalwerte, so erhält man einen etwas kleineren Wert: | ||

| − | $$m_1\hspace{0. | + | :$$m_1\hspace{0.01cm}' = 4/12 \cdot 1\,{\rm V}+ 8/12 \cdot 3\,{\rm V}= 2.33 \,{\rm V}. $$ |

Hier wurden die Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ bzw. $p_{\rm H} = 0.8$ durch die entsprechenden Häufigkeiten $h_{\rm L} = 4/12$ und $h_{\rm H} = 8/12$ ersetzt. Der relative Fehler aufgrund der unzureichenden Folgenlänge $N$ ist im Beispiel größer als $10\%$. | Hier wurden die Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ bzw. $p_{\rm H} = 0.8$ durch die entsprechenden Häufigkeiten $h_{\rm L} = 4/12$ und $h_{\rm H} = 8/12$ ersetzt. Der relative Fehler aufgrund der unzureichenden Folgenlänge $N$ ist im Beispiel größer als $10\%$. | ||

| − | ''Hinweis | + | |

| − | Wir bezeichnen hier Binärsymbole wie in der Schaltungstechnik mit $\rm L$ (Low) und $\rm H$ (High), um Verwechslungen zu vermeiden. In der Codierungstheorie wird sinnvollerweise $\{ \text{L, H}\}$ auf $\{0, 1\}$ abgebildet, um die Möglichkeiten der Modulo-Algebra nutzen zu können. Zur Beschreibung der Modulation mit bipolaren (antipodalen) Signalen wählt man dagegen besser die Zuordnung $\{ \text{L, H}\}$ ⇔ $ \{-1, +1\}$. | + | ''Hinweis zu unserer (zugegebenermaßen etwas ungewöhnlicher) Nomenklatur:'' |

| − | + | ||

| + | Wir bezeichnen hier Binärsymbole wie in der Schaltungstechnik mit $\rm L$ (Low) und $\rm H$ (High), um Verwechslungen zu vermeiden. | ||

| + | *In der Codierungstheorie wird sinnvollerweise $\{ \text{L, H}\}$ auf $\{0, 1\}$ abgebildet, um die Möglichkeiten der Modulo-Algebra nutzen zu können. | ||

| + | *Zur Beschreibung der Modulation mit bipolaren (antipodalen) Signalen wählt man dagegen besser die Zuordnung $\{ \text{L, H}\}$ ⇔ $ \{-1, +1\}$. | ||

| + | }} | ||

==Quadratischer Mittelwert – Varianz – Streuung== | ==Quadratischer Mittelwert – Varianz – Streuung== | ||

| + | <br> | ||

| + | {{BlaueBox|TEXT= | ||

| + | $\text{Definitionen:}$ | ||

| + | |||

Analog zum linearen Mittelwert erhält man mit $k = 2$ für den '''quadratischen Mittelwert''': | Analog zum linearen Mittelwert erhält man mit $k = 2$ für den '''quadratischen Mittelwert''': | ||

| − | $$m_2 =\sum_{\mu=\rm 1}^{\it M}p_\mu\cdot z_\mu^2 =\lim_{N\to\infty}\frac{\rm 1}{\it N}\sum_{\nu=\rm 1}^{\it N}z_\nu^2.$$ | + | :$$m_2 =\sum_{\mu=\rm 1}^{\it M}p_\mu\cdot z_\mu^2 =\lim_{N\to\infty}\frac{\rm 1}{\it N}\sum_{\nu=\rm 1}^{\it N}z_\nu^2.$$ |

| − | |||

Zusammen mit dem Gleichanteil $m_1$ kann daraus als weitere Kenngröße die '''Varianz''' $σ^2$ bestimmt werden (''Satz von Steiner''): | Zusammen mit dem Gleichanteil $m_1$ kann daraus als weitere Kenngröße die '''Varianz''' $σ^2$ bestimmt werden (''Satz von Steiner''): | ||

| − | $$\sigma^2=m_2-m_1^2.$$ | + | :$$\sigma^2=m_2-m_1^2.$$ |

Als '''Streuung''' $σ$ bezeichnet man in der Statistik die Quadratwurzel der Varianz; manchmal wird diese Größe auch ''Standardabweichung'' genannt: | Als '''Streuung''' $σ$ bezeichnet man in der Statistik die Quadratwurzel der Varianz; manchmal wird diese Größe auch ''Standardabweichung'' genannt: | ||

| − | $$\sigma=\sqrt{m_2-m_1^2}.$$ | + | :$$\sigma=\sqrt{m_2-m_1^2}.$$}} |

| − | |||

| Line 55: | Line 71: | ||

*Bei Nachrichtensignalen gibt $m_2$ die (mittlere) ''Leistung'' eines Zufallssignals an, bezogen auf den Widerstand $1 \hspace{0.03cm} Ω$. | *Bei Nachrichtensignalen gibt $m_2$ die (mittlere) ''Leistung'' eines Zufallssignals an, bezogen auf den Widerstand $1 \hspace{0.03cm} Ω$. | ||

| − | *Beschreibt $z$ eine Spannung, so besitzt $m_2$ die Einheit ${\rm V}^2$. | + | *Beschreibt $z$ eine Spannung, so besitzt dementsptrechend $m_2$ die Einheit ${\rm V}^2$. |

| − | *Die Varianz $σ^2$ eines Zufallssignals entspricht physikalisch der ''Wechselleistung'' und die Streuung $σ$ dem ''Effektivwert.'' | + | *Die Varianz $σ^2$ eines Zufallssignals entspricht physikalisch der ''Wechselleistung'' und die Streuung $σ$ dem ''Effektivwert.'' |

| + | *Diesen Definitionen liegt wiederum der Bezugswiderstand $1 \hspace{0.03cm} Ω$ zugrunde. | ||

| − | + | ||

| − | + | Das Lernvideo [[Momentenberechnung bei diskreten Zufallsgrößen (Lernvideo)|Momentenberechnung bei diskreten Zufallsgrößen]] verdeutlicht die definierten Größen am Beispiel eines Digitalsignals. | |

| − | |||

[[File:P_ID456__Sto_T_2_2_S3_neu.png | right|frame|Standardabweichung eines Binärsignals]] | [[File:P_ID456__Sto_T_2_2_S3_neu.png | right|frame|Standardabweichung eines Binärsignals]] | ||

| − | Ein Binärsignal mit den Amplitudenwerten | + | {{GraueBox|TEXT= |

| + | $\text{Beispiel 2:}$ | ||

| + | Ein Binärsignal $x(t)$ mit den Amplitudenwerten | ||

*$1\hspace{0.05cm}\rm V$ (für das Symbol $\rm L$), und | *$1\hspace{0.05cm}\rm V$ (für das Symbol $\rm L$), und | ||

*$3\hspace{0.05cm}\rm V$ (für das Symbol $\rm H$) | *$3\hspace{0.05cm}\rm V$ (für das Symbol $\rm H$) | ||

| − | |||

| − | Mit $m_1 = 2.6 \hspace{0.05cm}\rm V$ (siehe | + | sowie den Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ bzw. $p_{\rm H} = 0.8$ besitzt die gesamte Signalleistung |

| + | :$$P_{\rm Gesamt} = 0.2 \cdot (1\,{\rm V})^2+ 0.8 \cdot (3\,{\rm V})^2 = 7.4 \hspace{0.05cm}{\rm V}^2,$$ | ||

| + | |||

| + | wenn man vom Bezugswiderstand $R = 1 \hspace{0.05cm} Ω$ ausgeht. | ||

| + | |||

| + | Mit dem Gleichanteil $m_1 = 2.6 \hspace{0.05cm}\rm V$ (siehe Beispiel 1) folgt daraus für | ||

*die Wechselleistung $P_{\rm W} = σ^2 = 0.64\hspace{0.05cm} {\rm V}^2$, | *die Wechselleistung $P_{\rm W} = σ^2 = 0.64\hspace{0.05cm} {\rm V}^2$, | ||

*den Effektivwert $s_{\rm eff} = σ = 0.8 \hspace{0.05cm} \rm V$. | *den Effektivwert $s_{\rm eff} = σ = 0.8 \hspace{0.05cm} \rm V$. | ||

| Line 77: | Line 99: | ||

Bei anderem Bezugswiderstand ⇒ $R \ne 1 \hspace{0.05cm} Ω$ gelten obige Bezeichnungen nur bedingt. Beispielsweise haben mit $R = 50 \hspace{0.05cm} Ω$ die Leistung $P$, die Wechselleistung $P_{\rm W}$ und der Effektivwert $s_{\rm eff}$ folgende Werte: | Bei anderem Bezugswiderstand ⇒ $R \ne 1 \hspace{0.05cm} Ω$ gelten obige Bezeichnungen nur bedingt. Beispielsweise haben mit $R = 50 \hspace{0.05cm} Ω$ die Leistung $P$, die Wechselleistung $P_{\rm W}$ und der Effektivwert $s_{\rm eff}$ folgende Werte: | ||

| − | $$P \hspace{-0.05cm}= \hspace{-0.05cm} \frac{m_2}{R} \hspace{-0.05cm}= \hspace{-0.05cm} \frac{7.4\,{\rm V}^2}{50\,{\rm \Omega}} \hspace{-0.05cm}= \hspace{-0.05cm}0.148\,{\rm W},\hspace{0.15cm} | + | :$$P \hspace{-0.05cm}= \hspace{-0.05cm} \frac{m_2}{R} \hspace{-0.05cm}= \hspace{-0.05cm} \frac{7.4\,{\rm V}^2}{50\,{\rm \Omega}} \hspace{-0.05cm}= \hspace{-0.05cm}0.148\,{\rm W},\hspace{0.15cm} |

P_{\rm W} \hspace{-0.05cm} = \hspace{-0.05cm} \frac{\sigma^2}{R} \hspace{-0.05cm}= \hspace{-0.05cm}12.8\,{\rm mW} \hspace{0.05cm},\hspace{0.15cm} | P_{\rm W} \hspace{-0.05cm} = \hspace{-0.05cm} \frac{\sigma^2}{R} \hspace{-0.05cm}= \hspace{-0.05cm}12.8\,{\rm mW} \hspace{0.05cm},\hspace{0.15cm} | ||

| − | s_{\rm eff} \hspace{-0.05cm} = \hspace{-0.05cm}\sqrt{R \cdot P_{\rm W}} \hspace{-0.05cm}= \hspace{-0.05cm} \sigma \hspace{-0.05cm}= \hspace{-0.05cm} 0.8\,{\rm V}.$$ | + | s_{\rm eff} \hspace{-0.05cm} = \hspace{-0.05cm}\sqrt{R \cdot P_{\rm W}} \hspace{-0.05cm}= \hspace{-0.05cm} \sigma \hspace{-0.05cm}= \hspace{-0.05cm} 0.8\,{\rm V}.$$}} |

| − | |||

| − | |||

==Aufgaben zum Kapitel== | ==Aufgaben zum Kapitel== | ||

| + | <br> | ||

| + | [[Aufgaben:2.2 Mehrstufensignale|Aufgabe 2.2: Mehrstufensignale]] | ||

| − | [[Aufgaben:2. | + | [[Aufgaben:2.2Z_Diskrete_Zufallsgrößen|Aufgabe 2.2Z:Diskrete Zufallsgrößen]] |

| − | |||

| − | |||

{{Display}} | {{Display}} | ||

Revision as of 15:50, 4 April 2018

Contents

Berechnung als Schar- bzw. Zeitmittelwert

Die Wahrscheinlichkeiten bzw. die relativen Häufigkeiten liefern weitreichende Informationen über eine diskrete Zufallsgröße. Reduzierte Informationen erhält man durch die so genannten Momente $m_k$, wobei $k$ eine natürliche Zahl darstellt.

$\text{Zwei alternative Berechnungsmöglichkeiten:}$ Unter der hier stillschweigend vorausgesetzten Ergodizität gibt es für das Moment $k$-ter Ordnung zwei unterschiedliche Berechnungsmöglichkeiten:

- die Scharmittelung bzw. Erwartungswertbildung (Mittelung über alle möglichen Werte):

- $$m_k = {\rm E} [z^k ] = \sum_{\mu = 1}^{M}p_\mu \cdot z_\mu^k \hspace{2cm} \rm mit \hspace{0.1cm} {\rm E[\text{ ...} ]\hspace{-0.1cm}:} \hspace{0.1cm} \rm Erwartungswert ,$$

- die Zeitmittelung über die Zufallsfolge $\langle z_ν\rangle$ mit der Laufvariablen $ν = 1 , \hspace{0.1cm}\text{ ...} \hspace{0.1cm} , N$:

- $$m_k=\overline{z_\nu^k}=\hspace{0.01cm}\lim_{N\to\infty}\frac{1}{N}\sum_{\nu=\rm 1}^{\it N}z_\nu^k\hspace{1.7cm}\rm mit\hspace{0.1cm}\ddot{u}berstreichender\hspace{0.1cm}Linie\hspace{-0.1cm}:\hspace{0.1cm}Zeitmittelwert.$$

Anzumerken ist:

- Beide Berechnungsarten führen für genügend große Werte von $N$ zum gleichen asymptotischen Ergebnis.

- Bei endlichem $N$ ergibt sich ein vergleichbarer Fehler, als wenn die Wahrscheinlichkeit durch die relative Häufigkeit angenähert wird.

Linearer Mittelwert - Gleichanteil

$\text{Definition:}$ Mit $k = 1$ erhält man aus der allgemeinen Gleichung für die Momente den linearen Mittelwert:

- $$m_1 =\sum_{\mu=1}^{M}p_\mu\cdot z_\mu =\lim_{N\to\infty}\frac{1}{N}\sum_{\nu=1}^{N}z_\nu.$$

Der linke Teil dieser Gleichung beschreibt die Scharmittelung (über alle möglichen Werte), während die rechte Gleichung die Bestimmung als Zeitmittelwert angibt. In Zusammenhang mit Signalen wird diese Größe auch als der Gleichanteil bezeichnet.

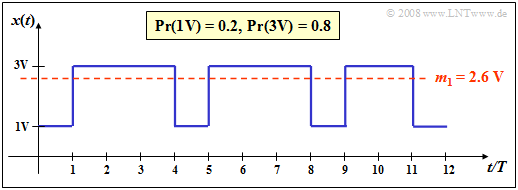

$\text{Beispiel 1:}$ Ein Binärsignal $x(t)$ mit den beiden möglichen Amplitudenwerten

- $1\hspace{0.03cm}\rm V$ (für das Symbol $\rm L$),

- $3\hspace{0.03cm}\rm V$ (für das Symbol $\rm H$)

sowie den Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ bzw. $p_{\rm H} = 0.8$ besitzt den linearen Mittelwert (Gleichanteil )

- $$m_1 = 0.2 \cdot 1\,{\rm V}+ 0.8 \cdot 3\,{\rm V}= 2.6 \,{\rm V}. $$

Dieser ist in der Grafik als rote Linie eingezeichnet.

Bestimmt man diese Kenngröße durch Zeitmittelung über die dargestellten $N = 12$ Signalwerte, so erhält man einen etwas kleineren Wert:

- $$m_1\hspace{0.01cm}' = 4/12 \cdot 1\,{\rm V}+ 8/12 \cdot 3\,{\rm V}= 2.33 \,{\rm V}. $$

Hier wurden die Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ bzw. $p_{\rm H} = 0.8$ durch die entsprechenden Häufigkeiten $h_{\rm L} = 4/12$ und $h_{\rm H} = 8/12$ ersetzt. Der relative Fehler aufgrund der unzureichenden Folgenlänge $N$ ist im Beispiel größer als $10\%$.

Hinweis zu unserer (zugegebenermaßen etwas ungewöhnlicher) Nomenklatur:

Wir bezeichnen hier Binärsymbole wie in der Schaltungstechnik mit $\rm L$ (Low) und $\rm H$ (High), um Verwechslungen zu vermeiden.

- In der Codierungstheorie wird sinnvollerweise $\{ \text{L, H}\}$ auf $\{0, 1\}$ abgebildet, um die Möglichkeiten der Modulo-Algebra nutzen zu können.

- Zur Beschreibung der Modulation mit bipolaren (antipodalen) Signalen wählt man dagegen besser die Zuordnung $\{ \text{L, H}\}$ ⇔ $ \{-1, +1\}$.

Quadratischer Mittelwert – Varianz – Streuung

$\text{Definitionen:}$

Analog zum linearen Mittelwert erhält man mit $k = 2$ für den quadratischen Mittelwert:

- $$m_2 =\sum_{\mu=\rm 1}^{\it M}p_\mu\cdot z_\mu^2 =\lim_{N\to\infty}\frac{\rm 1}{\it N}\sum_{\nu=\rm 1}^{\it N}z_\nu^2.$$

Zusammen mit dem Gleichanteil $m_1$ kann daraus als weitere Kenngröße die Varianz $σ^2$ bestimmt werden (Satz von Steiner):

- $$\sigma^2=m_2-m_1^2.$$

Als Streuung $σ$ bezeichnet man in der Statistik die Quadratwurzel der Varianz; manchmal wird diese Größe auch Standardabweichung genannt:

- $$\sigma=\sqrt{m_2-m_1^2}.$$

Hinweise zu den Einheiten:

- Bei Nachrichtensignalen gibt $m_2$ die (mittlere) Leistung eines Zufallssignals an, bezogen auf den Widerstand $1 \hspace{0.03cm} Ω$.

- Beschreibt $z$ eine Spannung, so besitzt dementsptrechend $m_2$ die Einheit ${\rm V}^2$.

- Die Varianz $σ^2$ eines Zufallssignals entspricht physikalisch der Wechselleistung und die Streuung $σ$ dem Effektivwert.

- Diesen Definitionen liegt wiederum der Bezugswiderstand $1 \hspace{0.03cm} Ω$ zugrunde.

Das Lernvideo Momentenberechnung bei diskreten Zufallsgrößen verdeutlicht die definierten Größen am Beispiel eines Digitalsignals.

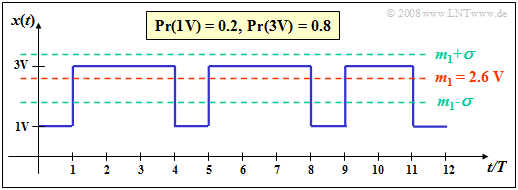

$\text{Beispiel 2:}$ Ein Binärsignal $x(t)$ mit den Amplitudenwerten

- $1\hspace{0.05cm}\rm V$ (für das Symbol $\rm L$), und

- $3\hspace{0.05cm}\rm V$ (für das Symbol $\rm H$)

sowie den Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ bzw. $p_{\rm H} = 0.8$ besitzt die gesamte Signalleistung

- $$P_{\rm Gesamt} = 0.2 \cdot (1\,{\rm V})^2+ 0.8 \cdot (3\,{\rm V})^2 = 7.4 \hspace{0.05cm}{\rm V}^2,$$

wenn man vom Bezugswiderstand $R = 1 \hspace{0.05cm} Ω$ ausgeht.

Mit dem Gleichanteil $m_1 = 2.6 \hspace{0.05cm}\rm V$ (siehe Beispiel 1) folgt daraus für

- die Wechselleistung $P_{\rm W} = σ^2 = 0.64\hspace{0.05cm} {\rm V}^2$,

- den Effektivwert $s_{\rm eff} = σ = 0.8 \hspace{0.05cm} \rm V$.

Die gleiche Varianz und der gleiche Effektivwert ergeben sich für die Amplitudenwerte $0\hspace{0.05cm}\rm V$ (für das Symbol $\rm L$) und $2\hspace{0.05cm}\rm V$ (für das Symbol $\rm H$), vorausgesetzt, die Auftrittswahrscheinlichkeiten $p_{\rm L} = 0.2$ und $p_{\rm H} = 0.8$ bleiben gleich.

Bei anderem Bezugswiderstand ⇒ $R \ne 1 \hspace{0.05cm} Ω$ gelten obige Bezeichnungen nur bedingt. Beispielsweise haben mit $R = 50 \hspace{0.05cm} Ω$ die Leistung $P$, die Wechselleistung $P_{\rm W}$ und der Effektivwert $s_{\rm eff}$ folgende Werte:

- $$P \hspace{-0.05cm}= \hspace{-0.05cm} \frac{m_2}{R} \hspace{-0.05cm}= \hspace{-0.05cm} \frac{7.4\,{\rm V}^2}{50\,{\rm \Omega <div style="clear:both;"> </div> </div> \hspace{-0.05cm}= \hspace{-0.05cm}0.148\,{\rm W},\hspace{0.15cm} P_{\rm W} \hspace{-0.05cm} = \hspace{-0.05cm} \frac{\sigma^2}{R} \hspace{-0.05cm}= \hspace{-0.05cm}12.8\,{\rm mW} \hspace{0.05cm},\hspace{0.15cm} s_{\rm eff} \hspace{-0.05cm} = \hspace{-0.05cm}\sqrt{R \cdot P_{\rm W}} \hspace{-0.05cm}= \hspace{-0.05cm} \sigma \hspace{-0.05cm}= \hspace{-0.05cm} 0.8\,{\rm V}.$$}}

Aufgaben zum Kapitel

Aufgabe 2.2: Mehrstufensignale

Aufgabe 2.2Z:Diskrete Zufallsgrößen